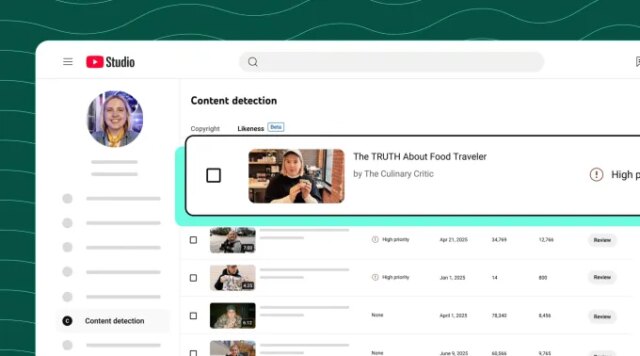

YouTube sta espandendo la sua tecnologia di rilevamento delle somiglianze, che identifica i deepfake generati dall’intelligenza artificiale, a un gruppo pilota di funzionari governativi, candidati politici e giornalisti. annunciato Martedì. I membri del gruppo pilota avranno accesso a uno strumento che rileva i contenuti non autorizzati generati dall’intelligenza artificiale e consente loro di richiederne la rimozione se ritengono che violi le norme di YouTube.

La tecnologia stessa è stata lanciata lo scorso anno a circa 4 milioni di creatori di YouTube nel Programma accomplice di YouTube, a seguito di check precedenti.

Simile a quello esistente di YouTube Sistema di identificazione dei contenutiche rileva materiale protetto da copyright nei video caricati dagli utenti, la funzione di rilevamento della somiglianza cerca volti simulati realizzati con strumenti di intelligenza artificiale. Questi strumenti vengono talvolta utilizzati per cercare di diffondere disinformazione e manipolare la percezione della realtà da parte delle persone, poiché sfruttano i personaggi falsificati di personaggi importanti – come politici o altri funzionari governativi – per dire e fare in questi video di intelligenza artificiale cose che non hanno fatto nella vita reale.

Con il nuovo programma pilota, YouTube mira a bilanciare la libera espressione degli utenti con i rischi associati alla tecnologia AI che può generare una somiglianza convincente di un personaggio pubblico.

“Questa espansione riguarda davvero l’integrità della conversazione pubblica”, ha affermato Leslie Miller, vicepresidente degli affari governativi e delle politiche pubbliche di YouTube, in una conferenza stampa prima del lancio di martedì. “Sappiamo che i rischi di imitazione dell’intelligenza artificiale sono particolarmente elevati per coloro che operano nello spazio civico. Ma mentre forniamo questo nuovo scudo, stiamo anche attenti a come lo utilizziamo”, ha osservato.

Miller ha spiegato che non tutte le corrispondenze rilevate verranno rimosse quando richiesto. YouTube valuterà invece ogni richiesta in base alle linee guida esistenti sulla privateness per determinare se il contenuto è una parodia o una critica politica, che sono forme protette di libera espressione.

La società ha notato che sta sostenendo queste protezioni anche a livello federale, con il suo sostegno al NESSUN atto FALSI in DC, che regolerebbe l’uso dell’intelligenza artificiale per creare ricreazioni non autorizzate della voce e della somiglianza visiva di un individuo.

Per utilizzare il nuovo strumento, i tester pilota idonei devono prima dimostrare la propria identità caricando un selfie e un documento d’identità governativo. Possono quindi creare un profilo, visualizzare le corrispondenze visualizzate e, facoltativamente, richiederne la rimozione. YouTube afferma che intende eventualmente dare alle persone la possibilità di impedire il caricamento di contenuti in violazione prima che vengano pubblicati o, possibilmente, consentire loro di monetizzare tali video, in modo simile a come funziona il suo sistema Content material ID.

La società non ha voluto confermare quali politici o funzionari saranno tra i primi tester, ma ha affermato che l’obiettivo è rendere la tecnologia ampiamente disponibile nel tempo.

Questi video AI verranno etichettati come tali, ma il posizionamento di queste etichette non è coerente. Per alcuni, l’etichetta appare nella descrizione del video, mentre i video incentrati su “argomenti più delicati” applicheranno l’etichetta nella parte anteriore del video. Questo è lo stesso approccio adottato da YouTube con tutti i contenuti generati dall’intelligenza artificiale.

“Ci sono molti contenuti prodotti con l’intelligenza artificiale, ma questa distinzione in realtà non è rilevante per il contenuto stesso”, ha spiegato Amjad Hanif, vicepresidente Creator Merchandise di YouTube, riguardo al posizionamento dell’etichetta. “Potrebbe essere un cartone animato generato con l’intelligenza artificiale. E quindi penso che ci sia un giudizio sul fatto che si tratti di una categoria che forse merita un disclaimer molto visibile”, ha detto.

YouTube al momento non condivide il numero di rimozioni di questo tipo di deepfake IA gestite da questa tecnologia di rilevamento dei deepfake nelle mani dei creatori, ma ha notato che la quantità di contenuti rimossi finora è stata “molto piccola”.

“Penso per molto [creators]è solo la consapevolezza di ciò che viene creato, ma il quantity delle richieste di rimozione effettivamente è davvero, davvero basso perché la maggior parte di esse risulta essere abbastanza benigna o aggiuntiva per il loro enterprise complessivo”, ha affermato Hanif.

Questo potrebbe non essere il caso dei deepfake di funzionari governativi, politici o giornalisti.

Col tempo, YouTube intende portare la sua tecnologia di rilevamento dei deepfake in più aree, comprese le voci parlate riconoscibili e altre proprietà intellettuali come i personaggi famosi.