Segui ZDNET: Aggiungici come fonte preferita su Google.

I principali punti salienti di ZDNET

- L’uso dell’intelligenza artificiale locale è responsabile e privato.

- GPT4All è un’intelligenza artificiale locale multipiattaforma gratuita e open supply.

- GPT4All funziona con più LLM e documenti locali.

Per quanto riguarda l’intelligenza artificiale, ho alcune regole per me: non è per scopi creativi, non deve essere usata come stampella per scrivere e, quando possibile, diventa locale.

Si tratta di un elenco abbastanza semplice, al quale, fino advert oggi, non è stato troppo difficile attenersi. Per molto tempo ho scelto di utilizzare Ollama perché è locale, funziona su tutte le piattaforme desktop ed è open supply.

Di recente, tuttavia, mi sono imbattuto in un altro strumento open supply che ha alcune funzionalità davvero interessanti. Questo strumento è GPT4All.

GPT4All è rilasciato sotto licenza MIT e può essere installato e utilizzato gratuitamente su Linux, MacOS e Home windows. Embrace tutte le funzionalità abituali, come la possibilità di aggiungere più LLM, follow-up, nessuna chiamata API o GPU richiesta, personalizzazione completa, chat di documenti locali (LocalDocs) e supporto per migliaia di modelli.

Anche: Ho provato un rivale di Claude Code che è locale, open supply e completamente gratuito: come è andata

Ho deciso di provare GPT4All e vedere come se la cavava con Ollama. Con mia grande sorpresa, mi ha conquistato abbastanza rapidamente.

Installiamo GPT4All e vediamo cosa succede.

Come installare GPT4All

Se utilizzi MacOS o Home windows, GPT4All è molto semplice da installare. Basta scaricare il file di installazione associato dal file Sito GPT4Allfare doppio clic sul file scaricato e seguire la procedura guidata di installazione.

Se usi Linux, le cose diventano un po’ complicate. Prima di tutto, GPT4All offre un programma di installazione solo per le distribuzioni basate su Ubuntu. Ho tentato per la prima volta di installare GPT4All su Pop!_OS. Quando l’ho fatto, ho ricevuto un errore che diceva che non riusciva a trovare le librerie Qt necessarie.

OK, allora. È l’ora di KDE Plasma.

Anche: Ho provato a risparmiare $ 1.200 codificando gratuitamente Vibe e me ne sono subito pentito

Ho avviato una macchina virtuale Fedora con KDE Plasma e ho eseguito il programma di installazione. No. Questa volta è stata la mancanza di una libreria X11 a causare il fallimento.

Bene. Ho fatto un altro tentativo, questa volta con KDE Neon. Ha funzionato e in meno di un minuto ho eseguito GPT4All su KDE Neon. Offrirò questo avvertimento: non tentare di installare GPT4All con privilegi di amministratore (sudo), poiché fallirà ogni volta. Scarica il file di installazione, assegnagli le autorizzazioni eseguibili con chmod u+x gpt4all-installer-linux.runquindi avviare il programma di installazione con ./gpt4all-installer-linux.run.

Inoltre: come ho reso Perplexity AI il motore di ricerca predefinito nel mio browser (e perché dovresti farlo anche tu)

Una volta installato, non importa quale piattaforma utilizzi perché la GUI e il set di funzionalità sono gli stessi su tutta la linea.

Come utilizzare GPT4All

Caricamento di un modello

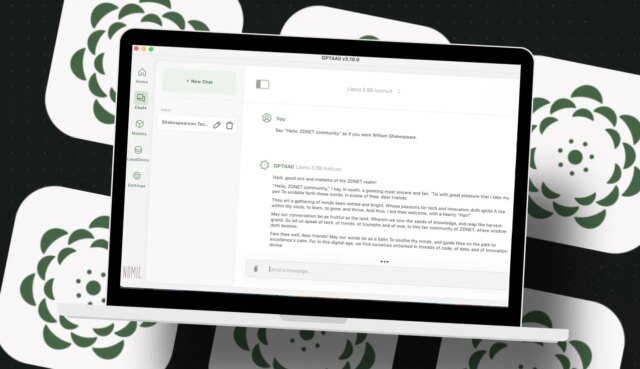

Se hai utilizzato l’intelligenza artificiale, in particolare l’intelligenza artificiale locale, ti sentirai come a casa con GPT4All. La GUI di GPT4All è molto ben strutturata, in modo story che potrai sfruttare tutte le sue funzionalità fin dall’inizio.

Anche: Ho testato l’intelligenza artificiale locale sul mio Mac M1, aspettandomi la magia, e invece ho ottenuto un controllo della realtà

Tuttavia, devi aggiungere un modello prima di iniziare. Per farlo, fai clic su Modelli nella barra laterale sinistra, quindi su Aggiungi modello.

GPT4All offre un’interfaccia utente molto pulita e facile da usare.

Jack Wallen/ZDNET

Nella finestra risultante, individua il modello che desideri aggiungere e fai clic su Scarica.

Puoi aggiungere tutti i modelli di cui hai bisogno.

Jack Wallen/ZDNET

Dopo aver scaricato il modello, fai clic su Chat nella barra laterale di sinistra, quindi fai clic su Carica per caricare il LLM appena scaricato. A questo punto iniziate advert inviare le vostre question, assicurandovi di verificare la validità dei risultati.

Ho scaricato il modello GPT4All Falcon perché non l’avevo mai provato. Quando ho posto la mia solita prima domanda (“Cos’è Linux?”), la risposta mi ha sorpreso.

In genere ricevo una risposta dettagliata con tantissimi dettagli, alcuni dei quali errati, su Linux. Questa volta, tuttavia, ho ricevuto una risposta di due frasi. Conciso.

Anche: Questa app MacOS gratuita è il segreto per ottenere di più dai tuoi modelli IA locali

Potrei anche proseguire con qualcosa del tipo: “Linux è adatto all’utilizzo desktop?” La risposta:

“Sì, Linux è una buona scelta per l’utilizzo desktop. Ha un’ampia gamma di applicazioni e può essere personalizzato per soddisfare le esigenze specifiche dei singoli utenti.”

Prendetelo, odiatori!

Aggiunta dei tuoi documenti

Una funzionalità che potrebbe piacerti è la possibilità di caricare i tuoi documenti e utilizzarli nelle tue question. Advert esempio, potresti aver scritto un tomo di articoli, tesi, monografie, ecc. e voler essere in grado di riassumerli, combinarli e utilizzarli per la ricerca. Ecco come farlo.

Anche: Questa è l’intelligenza artificiale locale più veloce che abbia mai provato e non si avvicina nemmeno a come ottenerla

Prima di farlo, dovresti raccogliere tutti i documenti che desideri aggiungere in una cartella dedicata. Dopo averlo fatto, fai clic su Documenti locali nella barra laterale di sinistra. Nella finestra risultante, fai clic su Aggiungi raccolta di documenti.

Mi sto preparando a caricare i miei documenti in GPT4All.

Jack Wallen/ZDNET

Ho fatto un check molto semplice con questa funzione. Ho aggiunto il mio curriculum di insegnamento a una nuova raccolta e ho chiesto al modello GPT4All Falcon: “Quali sono le credenziali di insegnamento di Jack Wallen?”

Con mia sorpresa, ha fallito e ha menzionato solo la mia esperienza relativa a Linux, che non si trova da nessuna parte in quel particolare curriculum. Ho deciso di rimuovere il modello Falcon e optare invece per un modello di lama.

Anche: Ho provato l’unico browser advert agenti che esegue l’intelligenza artificiale locale e ho riscontrato solo uno svantaggio

Sì. Ha funzionato e ha funzionato molto bene. Lezione appresa… scegli sempre il modello che ti serve in base al compito da svolgere.

La mia nuova IA locale?

Per quanto odio allontanarmi da Ollama, sembra che potrei avere una nuova app AI locale, almeno per MacOS. Fino a quando gli sviluppatori non renderanno possibile installare l’app su ambienti desktop non basati su Qt, dovrò restare con Alpaca su Linux.

Anche: Le mie due app IA preferite su Linux e come le utilizzo per fare di più

Forza, sviluppatori… destiny un favore a noi utenti Linux.