Una nuova tecnica sviluppata dai ricercatori dell’Università Jiao Tong di Shanghai e di altre istituzioni consente ai grandi agenti del modello linguistico di apprendere nuove competenze senza la necessità di costosi perfezionamenti.

Propongono i ricercatori MemRLuna struttura che offre agli agenti la capacità di sviluppare la memoria episodica, la capacità di recuperare esperienze passate per creare soluzioni per compiti invisibili. MemRL consente agli agenti di utilizzare il suggestions ambientale per affinare continuamente le proprie strategie di risoluzione dei problemi.

MemRL fa parte di una più ampia spinta allo sviluppo da parte della comunità di ricerca apprendimento continuo funzionalità per le applicazioni IA. Negli esperimenti sui principali benchmark del settore, il framework ha sovraperformato altri valori di base come RAG e altre tecniche di organizzazione della memoria, in particolare in ambienti complessi che richiedono esplorazione ed esperimenti. Ciò suggerisce che MemRL potrebbe diventare un componente fondamentale per la creazione di applicazioni IA che devono operare in contesti dinamici del mondo reale in cui requisiti e attività cambiano costantemente.

Il dilemma stabilità-plasticità

Una delle sfide centrali nell’implementazione delle applicazioni tramite agenti è l’adattamento del modello sottostante a nuove conoscenze e compiti dopo la fase di formazione iniziale. Gli approcci attuali generalmente rientrano in due categorie: approcci parametrici, come ritocchie approcci non parametrici, come RAG. Ma entrambi comportano compromessi significativi.

La messa a punto, sebbene efficace per inserire nuove informazioni, è computazionalmente costosa e lenta. In modo più critico, spesso porta a dimenticanza catastroficaun fenomeno in cui la conoscenza appena acquisita sovrascrive i dati precedentemente appresi, degradando le prestazioni generali del modello.

Al contrario, i metodi non parametrici come RAG sono fondamentalmente passivi; recuperano informazioni basandosi esclusivamente sulla somiglianza semantica, come gli incorporamenti di vettori, senza valutare l’effettiva utilità delle informazioni per la question di enter. Questo approccio presuppone che “simile implichi utile”, il che è spesso errato in compiti di ragionamento complessi.

I ricercatori sostengono che l’intelligenza umana risolve questo problema mantenendo “il delicato equilibrio tra la stabilità del ragionamento cognitivo e la plasticità della memoria episodica”. Nel cervello umano, il ragionamento stabile (associato alla corteccia) è disaccoppiato dalla memoria episodica dinamica. Ciò consente agli esseri umani di adattarsi a nuovi compiti senza “ricablare i circuiti neurali” (l’equivalente approssimativo della messa a punto del modello).

All’interno del framework MemRL

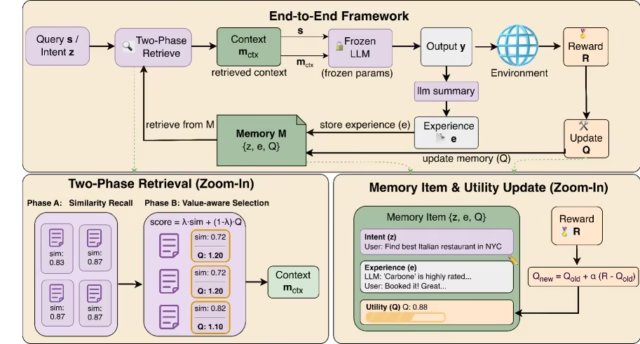

Ispirato dall’uso umano della memoria episodica e del ragionamento cognitivo, MemRL è progettato per consentire a un agente di migliorare continuamente le proprie prestazioni dopo l’implementazione senza compromettere la stabilità del suo spine LLM. Invece di modificare i parametri del modello, la struttura sposta il meccanismo di adattamento su una struttura di memoria esterna e autoevolutiva.

In questa architettura i parametri del LLM rimangono completamente congelati. Il modello agisce effettivamente come “corteccia”, responsabile del ragionamento generale, della logica e della generazione di codice, ma non è responsabile della memorizzazione di successi o fallimenti specifici riscontrati dopo la distribuzione. Questa struttura garantisce un ragionamento cognitivo stabile e previene l’oblio catastrofico.

Per gestire l’adattamento, MemRL mantiene una componente di memoria episodica dinamica. Invece di archiviare documenti di testo semplice e valori di incorporamento statici, come è comune in RAG, MemRL organizza la memoria in triplette “intento-esperienza-utilità”. Questi contengono la question dell’utente (l’intento), il percorso della soluzione specifica o l’azione intrapresa (l’esperienza) e un punteggio, noto come valore Q, che rappresenta il successo di questa specifica esperienza in passato (l’utilità).

Fondamentale per gli architetti aziendali, questa nuova struttura dati non richiede l’eliminazione dell’infrastruttura esistente. “MemRL è progettato per essere un sostituto ‘drop-in’ del livello di recupero negli stack tecnologici esistenti ed è compatibile con vari database vettoriali”, ha detto a VentureBeat Muning Wen, coautore dell’articolo e dottorando presso l’Università Jiao Tong di Shanghai. “L’esistenza e l’aggiornamento di ‘Q-Worth’ servono esclusivamente per una migliore valutazione e gestione dei dati dinamici… ed è indipendente dal formato di archiviazione.”

Questo punteggio di utilità è il principale elemento di differenziazione dai classici sistemi RAG. Al momento dell’inferenza, gli agenti MemRL utilizzano un meccanismo di “recupero a due fasi”. Innanzitutto, il sistema identifica i ricordi semanticamente vicini alla question per garantirne la pertinenza. Quindi riclassifica questi candidati in base al loro valore Q, dando effettivamente priorità alle strategie comprovate.

Il quadro incorpora l’apprendimento per rinforzo direttamente nel processo di recupero della memoria. Quando un agente tenta una soluzione e riceve un suggestions ambientale (advert esempio, successo o fallimento), aggiorna il valore Q della memoria recuperata. Ciò crea un ciclo di suggestions chiuso: nel tempo, l’agente impara a ignorare i ricordi di distrazione e a dare priorità alle strategie di alto valore senza mai dover riqualificare il LLM sottostante.

Anche se l’aggiunta di una fase di apprendimento per rinforzo potrebbe sembrare che aggiunga una latenza significativa, Wen ha notato che il sovraccarico computazionale è minimo. “Il nostro calcolo del valore Q viene eseguito interamente dalla CPU”, ha affermato.

MemRL possiede anche funzionalità di apprendimento continuo in fase di esecuzione. Quando l’agente incontra un nuovo state of affairs, il sistema utilizza l’LLM congelato per riassumere la nuova traiettoria e la aggiunge al banco di memoria come una nuova tripletta. Ciò consente all’agente di espandere dinamicamente la propria base di conoscenza mentre interagisce con il mondo.

Vale la pena notare che l’automazione dell’assegnazione del valore comporta un rischio: se il sistema convalida erroneamente un’interazione errata, l’agente potrebbe imparare la lezione sbagliata. Wen riconosce questo rischio di “memoria avvelenata”, ma osserva che, a differenza delle reti neurali a scatola nera, MemRL rimane trasparente e verificabile. “Se una cattiva interazione viene erroneamente classificata come un esempio positivo… potrebbe diffondersi più ampiamente”, ha detto Wen. “Tuttavia… possiamo facilmente risolverlo rimuovendo i dati contaminati dalla memoria o reimpostando i loro valori Q.”

MemRL in azione

I ricercatori hanno valutato MemRL rispetto a diversi valori di riferimento su quattro diversi parametri di riferimento del settore: BigCodeBench (generazione di codice), ALFWorld (navigazione incorporata), Lifelong Agent Bench (interazione tra sistema operativo e database) e Humanity’s Final Examination (ragionamento multidisciplinare complesso).

I risultati hanno mostrato che MemRL ha costantemente sovraperformato le linee di base sia nell’apprendimento in fase di esecuzione (migliorando durante la sessione) che nell’apprendimento di trasferimento (generalizzando advert attività invisibili).

I vantaggi di questo meccanismo di recupero consapevole del valore erano più pronunciati in ambienti advert alta intensità di esplorazione come ALFWorld. In questo benchmark, che richiede agli agenti di navigare e interagire con un ambiente domestico simulato, MemRL ha ottenuto un miglioramento relativo di circa il 56% rispetto a MemPun’altra struttura della memoria agentica. I ricercatori hanno scoperto che la componente dell’apprendimento per rinforzo incoraggiava effettivamente l’agente a esplorare e scoprire soluzioni per compiti complessi che i metodi di recupero basati sulla somiglianza spesso non riuscivano a risolvere.

Quando il banco di memoria è stato congelato e testato su set per misurare la generalizzazione, MemRL ha ottenuto la massima precisione tra i benchmark. Advert esempio, sul Lifelong Agent Bench, è migliorato significativamente rispetto alla base RAG commonplace sulle attività del sistema operativo. Ciò indica che il sistema non si limita a memorizzare i dati di addestramento, ma filtra efficacemente i ricordi di basso valore per conservare esperienze di alta utilità che si generalizzano a nuove situazioni.

Il quadro più ampio per gli agenti che si autoevolvono

MemRL si inserisce in un crescente corpo di ricerca focalizzato sui processi decisionali di Markov basati sulla memoria (M-MDP), una formulazione che inquadra il recupero della memoria come una fase decisionale attiva piuttosto che una funzione di ricerca passiva. Trattando il recupero come un’azione che può essere ottimizzata tramite l’apprendimento per rinforzo, framework come MemRL e approcci simili come Ricordo stanno aprendo la strada a sistemi più autonomi.

Per l’intelligenza artificiale aziendale, questo cambiamento è significativo. Suggerisce un futuro in cui gli agenti possono essere distribuiti con un LLM generico e quindi adattarsi rapidamente a flussi di lavoro aziendali specifici, database proprietari e serie di problemi unici attraverso la sola interazione. Il cambiamento chiave a cui stiamo assistendo riguarda i framework che trattano le applicazioni come ambienti dinamici da cui possono imparare.

Queste capacità emergenti consentiranno alle organizzazioni di mantenere agenti coerenti e advert alte prestazioni che si evolvono insieme alle loro esigenze aziendali, risolvendo il problema dei modelli obsoleti senza incorrere nei costi proibitivi di una costante riqualificazione.

Segna una transizione nel modo in cui valutiamo i dati. “In un futuro in cui i dati statici stanno per esaurirsi, l’esperienza di interazione generata da ciascun agente intelligente durante la sua vita diventerà il nuovo carburante”, ha affermato Wen.