Le applicazioni di intelligenza artificiale aziendale che gestiscono documenti di grandi dimensioni o attività a lungo orizzonte devono affrontare un grave collo di bottiglia della memoria. Man mano che il contesto si allunga, aumenta anche la cache KV, l’space in cui è archiviata la memoria di lavoro del modello.

Una nuova tecnica sviluppata dai ricercatori del MIT affronta questa sfida con un metodo di compressione veloce per la cache KV. La tecnica, chiamata Corrispondenza dell’attenzioneriesce a compattare il contesto fino a 50x con una perdita di qualità minima.

Sebbene non sia l’unica tecnica di compattazione della memoria disponibile, l’Consideration Matching si distingue per la sua velocità di esecuzione e le impressionanti capacità di conservazione delle informazioni.

Il collo di bottiglia della memoria della cache KV

I modelli linguistici di grandi dimensioni generano le loro risposte in sequenza, un token alla volta. Per evitare di ricalcolare da zero l’intera cronologia delle conversazioni per ogni parola prevista, il modello memorizza una rappresentazione matematica di ogni token precedente elaborato, noto anche come coppie chiave-valore. Questa memoria di lavoro critica è nota come cache KV.

La cache KV si adatta alla durata della conversazione perché il modello è costretto a conservare queste chiavi e valori per tutti i token precedenti in una determinata interazione. Ciò consuma costose risorse {hardware}. “In pratica, la memoria cache KV è il più grande collo di bottiglia per servire modelli in contesti ultra-lunghi”, ha detto a VentureBeat Adam Zweiger, coautore dell’articolo. “Limita la concorrenza, impone batch più piccoli e/o richiede un offload più aggressivo.”

Nei moderni casi d’uso aziendali, come l’analisi di massicci contratti legali, il mantenimento di dialoghi con i clienti multisessione o l’esecuzione di agenti di codifica autonomi, la cache KV può raggiungere molti gigabyte di memoria per una singola richiesta dell’utente.

Per risolvere questo enorme collo di bottiglia, il settore dell’intelligenza artificiale ha provato numerous strategie, ma questi metodi non sono all’altezza se implementati in ambienti aziendali in cui è necessaria una compressione estrema. Una serie di soluzioni tecniche embody l’ottimizzazione della cache KV eliminando i token che il modello ritiene meno importanti o unendo token simili in un’unica rappresentazione. Queste tecniche funzionano per una compressione lieve ma “si degradano rapidamente a rapporti di riduzione elevati”, secondo gli autori.

Le applicazioni del mondo reale spesso si basano su tecniche più semplici, con l’approccio più comune che consiste semplicemente nell’abbandonare il contesto precedente una volta raggiunto il limite di memoria. Ma questo approccio fa sì che il modello perda le informazioni più vecchie man mano che il contesto si allunga. Un’altra alternativa è il riepilogo del contesto, in cui il sistema fa una pausa, scrive un breve riassunto testuale del contesto precedente e sostituisce la memoria originale con quel riepilogo. Sebbene si tratti di uno customary di settore, il riepilogo comporta notevoli perdite e danneggia gravemente le prestazioni a valle perché potrebbe rimuovere informazioni pertinenti dal contesto.

Ricerche recenti hanno dimostrato che è tecnicamente possibile comprimere fortemente questa memoria utilizzando un metodo chiamato Cartucce. Tuttavia, questo approccio richiede l’addestramento dei modelli di cache KV latenti attraverso un’ottimizzazione matematica lenta ed end-to-end. Questo addestramento basato sul gradiente può richiedere numerous ore su GPU costose solo per comprimere un singolo contesto, rendendolo completamente impraticabile per le applicazioni aziendali in tempo reale.

Come la corrispondenza dell’attenzione si comprime senza costi

Consideration Matching raggiunge rapporti di compattazione e qualità di alto livello pur essendo ordini di grandezza più veloci dell’ottimizzazione basata sul gradiente. Evita il lento processo di allenamento attraverso ingegnosi trucchi matematici.

I ricercatori si sono resi conto che per imitare perfettamente il modo in cui un’intelligenza artificiale interagisce con la sua memoria, è necessario preservare due proprietà matematiche quando si comprimono i vettori di chiave e valore originali in un’impronta più piccola. Il primo è l’“output di attenzione”, ovvero le informazioni effettive che l’intelligenza artificiale estrae quando interroga la sua memoria. Il secondo è la “massa di attenzione”, che funge da peso matematico che un token ha rispetto a tutto il resto nella memoria di lavoro del modello. Se la memoria compressa può corrispondere a queste due proprietà, si comporterà esattamente come la memoria originale, di grandi dimensioni, anche quando in seguito verranno aggiunte nuove e imprevedibili richieste da parte dell’utente.

“La corrispondenza dell’attenzione è, in un certo senso, l’obiettivo ‘corretto’ per eseguire la compattazione del contesto latente in quanto mira direttamente a preservare il comportamento di ciascuna testa di attenzione dopo la compattazione”, ha affermato Zweiger. Sebbene il token dropping e le relative euristiche possano funzionare, l’abbinamento esplicito del comportamento di attenzione porta semplicemente a risultati migliori.

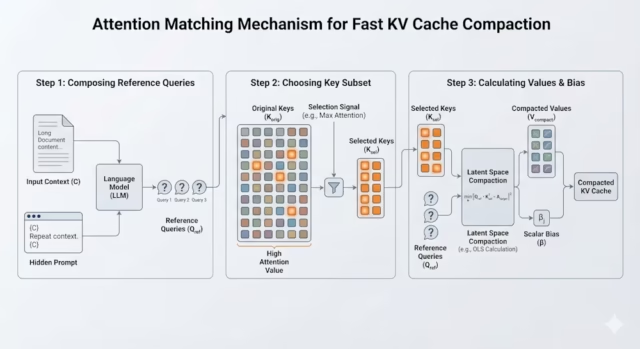

Prima di comprimere la memoria, il sistema genera un piccolo insieme di “question di riferimento” che fungono da proxy per i tipi di ricerche interne che il modello potrebbe eseguire quando ragiona sul contesto specifico. Se la memoria compressa può rispondere con precisione a queste domande di riferimento, molto probabilmente riuscirà a rispondere in seguito alle reali domande dell’utente. Gli autori suggeriscono vari metodi per generare queste question di riferimento, inclusa l’aggiunta di un immediate nascosto al documento che cube al modello di ripetere il contesto precedente, noto come tecnica di “ripetizione-preriempimento”. Suggeriscono anche un approccio di “autoapprendimento” in cui al modello viene richiesto di eseguire alcune rapide attività sintetiche sul documento, come l’aggregazione di tutti i fatti chiave o la strutturazione di date e numeri in un formato JSON.

Con queste question in mano, il sistema seleziona un set di chiavi da conservare nella cache KV compattata in base a segnali come il valore di attenzione più alto. Quindi utilizza le chiavi e le question di riferimento per calcolare i valori corrispondenti insieme a un termine di distorsione scalare. Questo bias garantisce che le informazioni pertinenti vengano preservate, consentendo a ciascuna chiave conservata di rappresentare la massa di molte chiavi rimosse.

Questa formulazione consente di adattare i valori con semplici tecniche algebriche, come i minimi quadrati ordinari e i minimi quadrati non negativi, evitando del tutto l’ottimizzazione basata su gradienti di calcolo pesanti. Questo è ciò che rende Consideration Matching tremendous veloce rispetto ai metodi di compattazione impegnativi in termini di ottimizzazione. I ricercatori applicano anche la compattazione a blocchi, elaborando porzioni contigue dell’enter in modo indipendente e concatenandole, per migliorare ulteriormente le prestazioni su contesti lunghi.

Corrispondenza dell’attenzione in azione

Per comprendere come funziona questo metodo nel mondo reale, i ricercatori hanno eseguito una serie di stress check utilizzando modelli open supply popolari come Llama 3.1 e Qwen-3 su due tipi distinti di set di dati aziendali. Il primo period QuALITY, un benchmark customary di comprensione della lettura che utilizzava documenti da 5.000 a 8.000 parole. Il secondo, che rappresentava una vera sfida aziendale, period LongHealth, un set di dati advert alta densità di 60.000 token contenente le complesse cartelle cliniche di più pazienti.

La scoperta chiave è stata la capacità di Consideration Matching di compattare la cache KV del modello di 50 volte senza ridurre la precisione, impiegando solo pochi secondi per elaborare i documenti. Per raggiungere lo stesso livello di qualità precedente, le cartucce richiedevano ore di calcolo intensivo della GPU per contesto.

Quando si ha a che fare con la fitta quantità di cartelle cliniche, le soluzioni different customary del settore crollano completamente. I ricercatori hanno notato che quando hanno provato a utilizzare il riepilogo testuale customary su queste cartelle cliniche, l’accuratezza del modello è scesa così in basso da corrispondere alla linea di base “senza contesto”, il che significa che l’IA si è comportata come se non avesse letto affatto il documento.

La corrispondenza dell’attenzione supera drasticamente il riepilogo, ma gli architetti aziendali dovranno ridurre il rapporto di compressione per compiti densi rispetto ai check di comprensione della lettura più semplici. Come spiega Zweiger, “Il principale compromesso pratico è che se si cerca di preservare quasi tutto nel contesto in attività advert alta densità di informazioni, generalmente è necessario un rapporto di compattazione più blando per mantenere una forte precisione.”

I ricercatori hanno anche esplorato cosa succede nei casi in cui non è necessaria la precisione assoluta ma lo è un risparmio di memoria estremo. Hanno eseguito la corrispondenza dell’attenzione sopra un riepilogo testuale customary. Questo approccio combinato ha raggiunto una compressione 200x. Ha eguagliato con successo la precisione del solo riepilogo customary, ma con un ingombro di memoria molto ridotto.

Uno degli esperimenti interessanti per i flussi di lavoro aziendali è stato il check della compattazione on-line, anche se notano che si tratta di una prova di concetto e non è stata testata rigorosamente in ambienti di produzione. I ricercatori hanno testato il modello sul check avanzato di ragionamento matematico AIME. Hanno costretto l’intelligenza artificiale a risolvere un problema con un limite di memoria fisica strettamente limitato. Ogni volta che la memoria del modello si riempiva, il sistema si fermava, comprimeva istantaneamente la sua memoria di lavoro del 50% utilizzando la corrispondenza dell’attenzione e gli lasciava continuare a pensare. Anche dopo aver colpito il muro della memoria e aver ridotto la cache KV fino a sei volte consecutive, il modello ha risolto con successo i problemi di matematica. Le sue prestazioni corrispondevano a quelle di un modello a cui period stata fornita una memoria massiccia e illimitata.

Ci sono avvertenze da considerare. Con un rapporto di compressione di 50x, Consideration Matching è il chiaro vincitore nel bilanciare velocità e qualità. Tuttavia, se un’azienda tenta di spingere la compressione fino ai limiti estremi di 100x su dati altamente complessi, il metodo Cartucce, più lento e basato sul gradiente, in realtà lo supera.

I ricercatori hanno rilasciato il codice per la corrispondenza dell’attenzione. Tuttavia, notano che al momento non si tratta di un semplice aggiornamento software program plug-and-play. “Penso che la compattazione latente sia meglio considerata una tecnica a livello di modello”, osserva Zweiger. “Sebbene possa essere applicato su qualsiasi modello esistente, richiede l’accesso ai pesi del modello.” Ciò significa che le aziende che si affidano interamente advert API chiuse non possono implementarle da sole; hanno bisogno di modelli a peso aperto.

Gli autori notano che l’integrazione di questa compattazione KV dello spazio latente nei motori di inferenza commerciale esistenti e altamente ottimizzati richiede ancora uno sforzo significativo. La moderna infrastruttura di intelligenza artificiale utilizza trucchi complessi come la memorizzazione nella cache dei prefissi e l’imballaggio della memoria a lunghezza variabile per mantenere i server in esecuzione in modo efficiente e integrare senza soluzione di continuità questa nuova tecnica di compattazione nei sistemi esistenti richiederà un lavoro di ingegneria dedicato. Tuttavia, esistono applicazioni aziendali instant. “Riteniamo che la compattazione dopo l’ingestione sia un caso d’uso promettente, in cui gli output di chiamate di strumenti di grandi dimensioni o documenti lunghi vengono compattati subito dopo essere stati elaborati”, ha affermato Zweiger.

In definitiva, lo spostamento verso la compattazione meccanica dello spazio latente è in linea con le future roadmap dei prodotti dei principali attori dell’intelligenza artificiale, sostiene Zweiger. “Stiamo assistendo al passaggio della compattazione da qualcosa che le imprese implementano autonomamente a qualcosa che i fornitori modello forniscono”, ha affermato Zweiger. “Ciò è ancora più vero per la compattazione latente, dove è necessario l’accesso ai pesi del modello. Advert esempio, OpenAI ora espone un endpoint di compattazione a scatola nera che restituisce un oggetto opaco anziché un riepilogo in testo semplice.”