Nonostante le turbolenze politiche nel settore dell’intelligenza artificiale negli Stati Uniti, in Cina i progressi dell’intelligenza artificiale continuano a ritmo sostenuto senza intoppi.

Oggi, il Qwen Group di ricercatori AI del colosso dell’e-commerce Alibaba, concentrato principalmente sullo sviluppo e il rilascio nel mondo di una famiglia crescente di potenti e capaci modelli Qwen open supply e di modelli AI multimodali, ha presentato il suo ultimo lotto, la serie di modelli piccoli Qwen3.5che consiste in:

-

Qwen3.5-0.8B e 2B: Due modelli, entrambi ottimizzati per prestazioni “piccole” e “veloci”, destinati alla prototipazione e all’implementazione su dispositivi edge dove la durata della batteria è fondamentale.

-

Qwen3.5-4B: Una solida base multimodale per agenti leggeri, che supporta nativamente una finestra di contesto di 262.144 token.

-

Qwen3.5-9B un modello di ragionamento compatto che supera la fonte aperta gpt-oss-120B del rivale statunitense OpenAI, 13,5 volte più grande, su benchmark chiave di terze parti, tra cui conoscenza multilingue e ragionamento a livello di laurea

Per metterlo in prospettiva, questi modelli sono nell’ordine dei più piccoli modelli per uso generale recentemente spediti da qualsiasi laboratorio in tutto il mondo, paragonabili più alla propaggine del MIT Serie LFM2 di LiquidAIche hanno anche various centinaia di milioni o miliardi di parametri, rispetto ai trilioni stimati di parametri (impostazioni del modello) utilizzati secondo quanto riferito per i modelli di punta di OpenAI, Anthropic e della serie Gemini di Google.

I pesi per i modelli sono già disponibili a livello globale con le licenze Apache 2.0, perfette per uso aziendale e commerciale, inclusa la personalizzazione secondo necessità, su Volto che abbraccia E ModelScope.

La tecnologia: efficienza ibrida e multimodalità nativa

Il fondamento tecnico della piccola serie Qwen3.5 è un allontanamento dalle architetture Transformer customary. Alibaba si è spostata verso un’architettura ibrida efficiente che combina reti delta recintate (una forma di attenzione lineare) con una miscela sparsa di esperti (MoE).

Questo approccio ibrido affronta il “muro della memoria” che tipicamente limita i modelli di piccole dimensioni; utilizzando le reti Gated Delta, i modelli raggiungono un throughput più elevato e una latenza significativamente inferiore durante l’inferenza.

Inoltre, questi modelli sono nativamente multimodali. A differenza delle generazioni precedenti che “collegavano” un codificatore di visione a un modello di testo, Qwen3.5 è stato addestrato utilizzando la fusione precoce su token multimodali. Ciò consente ai modelli 4B e 9B di mostrare un livello di comprensione visiva, come leggere gli elementi dell’interfaccia utente o contare gli oggetti in un video, che in precedenza richiedeva modelli dieci volte più grandi.

Benchmarking delle serie “piccole”: prestazioni che sfidano la scala

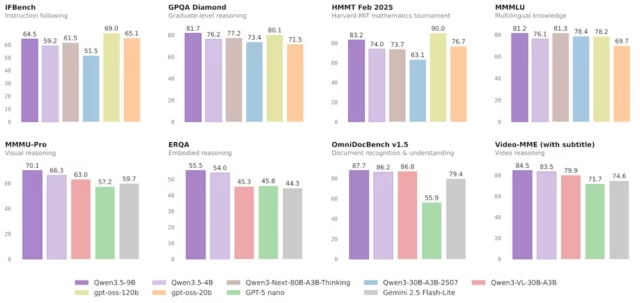

I dati di riferimento recentemente rilasciati illustrano quanto aggressivamente questi modelli compatti competono con, e spesso superano, customary di settore molto più ampi. Le varianti Qwen3.5-9B e Qwen3.5-4B dimostrano un salto intergenerazionale in termini di efficienza, in particolare nei compiti multimodali e di ragionamento.

Dominanza multimodale: Nel benchmark del ragionamento visivo MMMU-Professional, Qwen3.5-9B ha ottenuto un punteggio di 70,1, superando Gemini 2.5 Flash-Lite (59,7) e persino lo specializzato Qwen3-VL-30B-A3B (63,0).

Ragionamento a livello universitario: Sul benchmark GPQA Diamond, il modello 9B ha raggiunto un punteggio di 81,7, superando gpt-oss-120b (80,1), un modello con oltre dieci volte il numero di parametri.

Comprensione del video: La serie mostra prestazioni d’élite nel ragionamento video. Nel benchmark Video-MME (con sottotitoli), Qwen3.5-9B ha ottenuto 84,5 e il 4B ha ottenuto 83,5, superando significativamente Gemini 2.5 Flash-Lite (74,6).

Abilità matematica: Nella valutazione dell’HMMT del febbraio 2025 (torneo di matematica Harvard-MIT), il modello 9B ha ottenuto 83,2, mentre la variante 4B ha ottenuto 74,0, dimostrando che il ragionamento STEM di alto livello non richiede più enormi cluster di calcolo.

Conoscenza documentale e multilingue: La variante 9B è in testa al gruppo nel riconoscimento dei documenti su OmniDocBench v1.5 con un punteggio di 87,7. Nel frattempo, mantiene una presenza multilingue di alto livello su MMMLU con un punteggio di 81,2, superando gpt-oss-120b (78,2).

Reazioni della comunità: “più intelligenza, meno elaborazione”

Sulla scia del rilascio della scorsa settimana di un Qwen3.5-Medium open supply già piuttosto piccolo e potente in grado di funzionare su una singola GPU, l’annuncio della serie Qwen3.5-Small Fashions e il loro ingombro e requisiti di elaborazione ancora più ridotti hanno suscitato immediato interesse tra gli sviluppatori concentrati sull’intelligenza artificiale “local-first”.

“Più intelligenza, meno elaborazione” ha avuto risonanza tra gli utenti che cercavano various ai modelli basati su cloud.

Educatore di intelligenza artificiale e tecnologia Paolo Covert di Blueshell AI ha catturato lo shock del settore riguardo a questo salto di efficienza.

“Com’è possibile?!” Coperto ha scritto su X. “Qwen ha rilasciato 4 nuovi modelli e la versione 4B è capace quasi quanto la precedente 80B A3B. E la 9B è buona quanto GPT OSS 120b pur essendo 13 volte più piccola!”

L’analisi di Couvert evidenzia le implicazioni pratiche di questi vantaggi architettonici:

-

“Possono funzionare su qualsiasi laptop computer”

-

“0,8B e 2B per il tuo telefono”

-

“Offline e open supply”

Come sviluppatore Lo ha detto Karan Kendre del Kargul Studio: “questi modelli [can run] localmente sul mio MacBook Air M1 gratuitamente.”

Questo sentimento di accessibilità “straordinaria” trova eco in tutto l’ecosistema degli sviluppatori. Un utente ha notato che un modello 4B che funge da “forte base multimodale” è un “punto di svolta per gli sviluppatori mobili” che necessitano di capacità di lettura dello schermo senza un sovraccarico elevato della CPU.

In effetti, lo sviluppatore di Hugging Face – ha osservato Xenova che la nuova serie Qwen3.5 Small Mannequin può anche essere eseguita direttamente nel browser internet di un utente ed eseguire operazioni sofisticate e precedentemente impegnative in termini di calcolo come l’analisi video.

I ricercatori hanno anche elogiato il rilascio di Modelli base accanto alle versioni Instructsottolineando che fornisce un supporto essenziale per “l’innovazione industriale nel mondo reale”.

Il rilascio dei modelli Base è particolarmente apprezzato dalle aziende e dai crew di ricerca perché fornisce una “tabula rasa” che non è stata influenzata da un insieme specifico di dati RLHF (Reinforcement Studying from Human Suggestions) o SFT (Supervised Fantastic-Tuning), che spesso possono portare a “rifiuti” o stili di conversazione specifici difficili da annullare.

Ora, con i modelli Base, coloro che sono interessati a personalizzare il modello per adattarlo a compiti e scopi specifici hanno un punto di partenza più semplice, poiché ora possono applicare la propria messa a punto delle istruzioni e post-formazione senza dover eliminare quelle di Alibaba.

Licensing: una vittoria per l’ecosistema aperto

Alibaba ha rilasciato i pesi e i file di configurazione per la serie Qwen3.5 sotto la licenza Apache 2.0. Questa licenza permissiva consente l’uso commerciale, la modifica e la distribuzione senza pagamento di royalty, rimuovendo il “vincolo del fornitore” associato alle API proprietarie.

-

Uso commerciale: Gli sviluppatori possono integrare modelli in prodotti commerciali senza royalty.

-

Modifica: I crew possono ottimizzare (SFT) o applicare RLHF per creare versioni specializzate.

-

Distribuzione: I modelli possono essere ridistribuiti in applicazioni AI local-first come Ollama.

Contestualizzare la notizia: perché le piccole cose contano così tanto in questo momento

Il rilascio della serie Qwen3.5 Small arriva in un momento di “Riallineamento Agenti”. Abbiamo superato i semplici chatbot; l’obiettivo ora è l’autonomia. Un agente autonomo deve “pensare” (ragionare), “vedere” (multimodalità) e “agire” (uso degli strumenti). Anche se farlo con modelli da trilioni di parametri è proibitivo, un Qwen3.5-9B locale può eseguire questi cicli per una frazione del costo.

Scalando il Reinforcement Studying (RL) in ambienti con milioni di agenti, Alibaba ha dotato questi piccoli modelli di un “giudizio allineato all’uomo”, consentendo loro di gestire obiettivi in più fasi come l’organizzazione di un desktop o il reverse engineering di filmati di gioco in codice. Che si tratti di un modello 0.8B in esecuzione su uno smartphone o di un modello 9B che alimenta un terminale di codifica, la serie Qwen3.5 sta effettivamente democratizzando “l’period degli agenti”.

Il passaggio della serie Qwen3.5 dai “chatbit” agli “agenti multimodali nativi” trasforma il modo in cui le aziende possono distribuire l’intelligence. Spostando un ragionamento sofisticato all'”edge”, ovvero singoli dispositivi e server locali, le organizzazioni possono automatizzare attività che in precedenza richiedevano costose API cloud o elaborazione a latenza elevata.

Applicazioni e considerazioni aziendali strategiche

I modelli da 0,8B a 9B sono stati riprogettati per garantire efficienza, utilizzando un’architettura ibrida che attiva solo le parti necessarie della rete per ciascuna attività.

-

Automazione del flusso di lavoro visivo: Utilizzando il “pixel-level grounding”, questi modelli possono navigare nelle interfacce utente desktop o mobili, compilare moduli e organizzare file in base alle istruzioni in linguaggio naturale.

-

Analisi di documenti complessi: Con punteggi superiori al 90% sui benchmark di comprensione dei documenti, possono sostituire OCR separati e pipeline di analisi del structure per estrarre dati strutturati da diversi moduli e grafici.

-

Codifica e refactoring autonomi: Le aziende possono inserire interi repository (fino a 400.000 righe di codice) nella finestra di contesto 1M per refactoring pronti per la produzione o debug automatizzato.

-

Analisi dei bordi in tempo reale: I modelli 0.8B e 2B sono progettati per dispositivi mobili e consentono il riepilogo video offline (fino a 60 secondi a 8 FPS) e il ragionamento spaziale senza compromettere la durata della batteria.

La tabella seguente illustra quali funzioni aziendali trarranno il massimo vantaggio dall’implementazione locale di piccoli modelli.

|

Funzione |

Beneficio primario |

Caso d’uso chiave |

|

Ingegneria del software program |

Intelligenza del codice locale |

Refactoring a livello di repository e codifica advert agenti basata su terminale. |

|

Operazioni e IT |

Automazione sicura |

Automatizzazione delle impostazioni di sistema in più fasi e delle attività di gestione dei file in locale. |

|

Prodotto e esperienza utente |

Interazione sui bordi |

Integrazione del ragionamento multimodale nativo direttamente nelle app mobili/desktop. |

|

Dati e analisi |

Estrazione efficiente |

OCR advert alta fedeltà ed estrazione strutturata di dati da report visivi complessi. |

Sebbene questi modelli siano altamente efficaci, la loro piccola scala e la loro natura “agente” introducono “bandierine” operative specifiche che i crew devono monitorare.

-

La cascata delle allucinazioni: Nei flussi di lavoro “agenti” a più fasi, un piccolo errore in una fase iniziale può portare a una “cascata” di fallimenti in cui l’agente persegue un piano errato o privo di senso.

-

Debug e codifica Greenfield: Sebbene questi modelli eccellano nella scrittura di nuovo codice “greenfield”, possono avere difficoltà con il debug o la modifica di sistemi legacy complessi e esistenti.

-

Richieste di memoria e VRAM: Anche i modelli “piccoli” (come il 9B) richiedono una VRAM significativa per l’inferenza advert alto rendimento; l'”impronta di memoria” rimane elevata perché il conteggio totale dei parametri occupa ancora lo spazio della GPU.

-

Residenza normativa e dei dati: L’utilizzo di modelli di un supplier con sede in Cina può sollevare dubbi sulla residenza dei dati in alcune giurisdizioni, sebbene la versione open-weight di Apache 2.0 consenta l’internet hosting su cloud locali “sovrani”.

Le aziende dovrebbero dare la priorità alle attività “verificabili”, come la codifica, la matematica o il seguito delle istruzioni, in cui l’output può essere controllato automaticamente rispetto a regole predefinite per prevenire “hacking di ricompensa” o fallimenti silenziosi.