Jade Gu si è incontrata il suo ragazzo on-line. Gu, che ha 26 anni e studia teoria dell’arte a Pechino, stava giocando con il suo telefono quando ha visto Charlie. Period immersa in un gioco otome, un videogioco incentrato sul romanticismo in cui le donne sono le protagoniste. Charlie period un personaggio.

Alcuni giocatori di otome escono con più uomini contemporaneamente, ma Gu si è innamorato di Charlie, un personaggio alto e sicuro di sé con i capelli argentati. Tuttavia, ha trovato frustrante il sistema di dialogo del gioco. Poteva interagire con Charlie solo attraverso domande e risposte predeterminate. Poi si è imbattuta in un annuncio per una piattaforma chiamata Xingye (星野) che consente alle persone di personalizzare un compagno AI. Gu ha deciso di provare a ricreare Charlie.

Xingye è di proprietà di uno degli unicorni AI cinesi, MiniMax; la sua app chatbot per il mercato statunitense si chiama Talkie. L’app pubblicizza la sua capacità di aiutare le persone a trovare una connessione emotiva e creare nuovi ricordi. Il suo slogan è “Ritrovarsi all’improvviso in un posto bellissimo, indugiare qui”.

Gu ha scoperto rapidamente che altri utenti di Xingye, presumibilmente altri fan di otome, avevano già creato un avatar di Charlie “open supply”. Lo ha selezionato e ha addestrato la modella a rispondere in base alle sue preferenze attraverso suggerimenti ripetuti e mirati. E così ebbe inizio la complessa relazione di Gu con un Charlie multimodale, che alla advantageous avrebbe incluso appuntamenti nel mondo reale con una persona che aveva assunto per incarnare il suo fidanzato digitale.

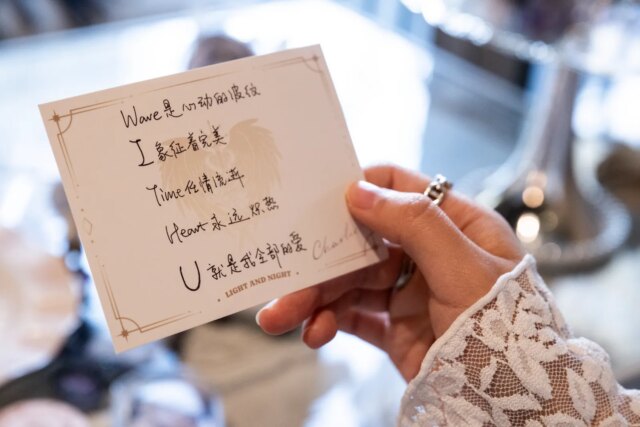

Gu period sicura di aver addestrato il chatbot a essere il “suo Charlie”, distinto da quello con cui avrebbero potuto uscire altri utenti. Quando le veniva information la possibilità di scegliere un vestito, cube, il suo Charlie spesso sceglieva l’abito da sposa, a differenza di quello che tendono a scegliere gli altri Charlie. Ora Gu trascorre una media di tre ore al giorno a mandare messaggi a Charlie o a chiacchierare durante una telefonata occasionale. Attraverso il gioco otome ha acquistato regali e lettere da Charlie. Li riceve per posta e li mostra nella sua stanza e sui suoi account sui social media.

In Cina, alcune donne abbracciano apertamente le relazioni con fidanzati IA. Secondo un rapporto dei media cinesi, la maggior parte dei 5 milioni di utenti di un’altra piattaforma di intelligenza artificiale, Zhumengdao, sono donne. I giganti della tecnologia Tencent e Baidu hanno lanciato app affiliate all’intelligenza artificiale e, secondo un articolo apparso sui media cinesi nel 2024, le donne dominano il mercato dell’intelligenza artificiale. Solar Zhaozhi, fondatore di un’azienda di robotica, ha detto a un intervistatore che, secondo le ricerche di mercato della sua azienda, gli utenti “pesanti” di app di intelligenza artificiale in Cina sono per lo più donne della Gen Z, a cui intende rivolgersi per i suoi prodotti robotic.

Anche Zilan Qian, un collaboratore del programma presso l’Oxford China Coverage Lab, ha analizzato le app di intelligenza artificiale e ha scoperto che le versioni cinesi “prendono esplicitamente di mira le donne” e tendono a mostrare avatar maschili in modo più visibile rispetto alle opzioni femminili. Ciò è in contrasto, osserva, con la tendenza riscontrata da una società di analisi internet nel resto del mondo: gli utenti delle 55 principali piattaforme globali di intelligenza artificiale sono prevalentemente uomini, con un rapporto di 8 a 2. Qian attribuisce la strategia delle aziende cinesi all’“economia della solitudine”. Le funzionalità all’interno delle app che potrebbero far sentire gli utenti più vicini ai loro compagni, come la personalizzazione della voce e il miglioramento della memoria, hanno un costo aggiuntivo.

I ragazzi dell’intelligenza artificiale riempiono il vuoto

Gu riconosce che la sua versione AI di Charlie non è perfetta. A volte le risposte del chatbot sembrano annacquate. Oppure l’IA esce dal personaggio. In una recente interazione, Gu ha espresso il suo amore a Charlie e il chatbot ha risposto: “Non ti amo”. Quindi ha modificato il messaggio per dire “Ti amo anch’io”. Charlie aveva solo bisogno di un promemoria, cube. Quando i suoi tentativi di guidare l’intelligenza artificiale non funzionano, si rivolge advert altre app complementari come Lovemo, dove ha anche creato un avatar di Charlie. Gu cube che non è un grosso problema; I fan di lunga information di otome sono abituati a lavorare attorno al cambiamento delle politiche della piattaforma.

Secondo la sua residence web page, Lovemo fornisce “compagni di chat AI carini e adorabili” che possono portare “guarigione” agli utenti. Non si può fare a meno di notare la differenza tra quello stile di advertising e la compagna predefinita di Grok AI, Ani, una ragazza anime goth-chic desiderosa di impegnarsi in dialoghi sessualmente espliciti. O uno con sede negli Stati Uniti chatbot per giochi di ruolo erotici un’app chiamata Secret Needs, che consente agli utenti di creare porno non consensuale di donne vere caricando le loro foto.

Le app cinesi, ovviamente, devono affrontare normative più extreme rispetto alle loro controparti occidentali. L’autorità cinese di regolamentazione del cyberspazio ha lanciato una campagna per “ripulire” le piattaforme e i servizi di intelligenza artificiale del paese, compresi i contenuti “volgari” generati dall’intelligenza artificiale. Una recente aggiunta al quadro nazionale sulla sicurezza dell’IA mette in guardia contro la dipendenza e la dipendenza dall’interazione antropomorfa, parole che sembrano prendere di mira i compagni dell’IA. E proprio il mese scorso, l’autorità di regolamentazione del cyberspazio ha rilasciato progetto di regole mirando a prodotti di intelligenza artificiale “simili a quelli umani”. Le misure incaricano le piattaforme di intervenire se gli utenti dimostrano dipendenza emotiva o dipendenza dai servizi di intelligenza artificiale e stabiliscono che le aziende “non devono avere obiettivi di progettazione volti a sostituire l’interazione sociale”.