La sfida di gestire un modello di deep studying è spesso capire perché fa quello che fa: che si tratti delle ripetute sessioni di lotta di xAI per mettere a punto la strana politica di Grok, delle lotte di ChatGPT con il servilismo o di allucinazioni ordinarie, scandagliare una rete neurale con miliardi di parametri non è facile.

Information Labs, una start-up di San Francisco fondata dal CEO Julius Adebayo e dal chief science officer Aya Abdelsalam Ismail, offre oggi una risposta a questo problema. Lunedì, la società ha reso open supply un LLM da 8 miliardi di parametri, Sterling-8Baddestrato con una nuova architettura progettata per rendere le sue azioni facilmente interpretabili: ogni token prodotto dal modello può essere ricondotto alle sue origini nei dati di addestramento del LLM.

Ciò può essere semplice come determinare i materiali di riferimento per i fatti citati dal modello o complesso come comprendere la comprensione del modello dell’umorismo o del genere.

“Se ho un trilione di modi per codificare il genere, e lo codifico in 1 miliardo dei 1 trilioni di cose che ho, devi assicurarti di trovare tutte quelle 1 miliardo di cose che ho codificato, e poi devi essere in grado di accenderlo e spegnerlo in modo affidabile”, ha detto Adebayo a TechCrunch. “Puoi farlo con i modelli attuali, ma è molto fragile… È una specie di domanda sul Santo Graal.”

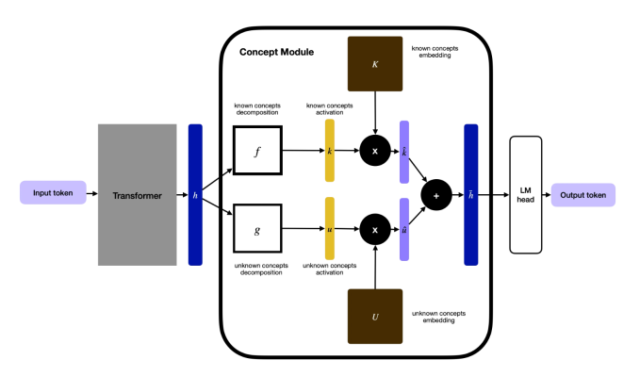

Adebayo ha iniziato questo lavoro mentre conseguiva il dottorato al MIT, ed è coautore di un libro ampiamente citato Documento del 2018 ciò ha dimostrato che i metodi esistenti per comprendere i modelli di deep studying non erano affidabili. Questo lavoro alla nice ha portato alla creazione di un nuovo modo di costruire LLM: gli sviluppatori inseriscono un livello concettuale nel modello che raggruppa i dati in categorie tracciabili. Ciò richiede un’annotazione dei dati più immediata, ma utilizzando altri modelli di intelligenza artificiale per aiutare, sono stati in grado di addestrare questo modello come la loro più grande prova di concetto finora.

“Il tipo di interpretabilità che le persone fanno è… neuroscienza su un modello, e noi lo capovolgiamo”, ha detto Adebayo. “Quello che facciamo è in realtà progettare il modello da zero in modo che non sia necessario fare neuroscienze.”

Una preoccupazione di questo approccio è che potrebbe eliminare alcuni dei comportamenti emergenti che rendono gli LLM così intriganti: la loro capacità di generalizzare in modi nuovi su cose su cui non sono stati ancora formati. Adebayo afferma che ciò accade ancora nel modello della sua azienda: il suo staff tiene traccia di quelli che chiamano “concetti scoperti” che il modello ha scoperto da solo, come l’informatica quantistica.

Evento Techcrunch

Boston, MA

|

9 giugno 2026

Adebayo sostiene che questa architettura interpretabile sarà qualcosa di cui tutti hanno bisogno. Per i LLM rivolti al consumatore, queste tecniche dovrebbero consentire ai creatori di modelli di fare cose come bloccare l’uso di materiali protetti da copyright o controllare meglio i risultati su argomenti come la violenza o l’abuso di droghe. Le industrie regolamentate richiederanno LLM più controllabili, advert esempio nella finanza, dove un modello che valuta i richiedenti un prestito deve considerare cose come i registri finanziari ma non la razza. C’è anche bisogno di interpretabilità nel lavoro scientifico, un’altra space in cui Information Labs ha sviluppato la tecnologia. Il ripiegamento delle proteine è stato un grande successo per i modelli di deep studying, ma gli scienziati hanno bisogno di maggiori informazioni sul motivo per cui il loro software program ha individuato combinazioni promettenti.

“Questo modello dimostra che la formazione di modelli interpretabili non è più una sorta di scienza; ora è un problema di ingegneria”, ha affermato Adebayo. “Abbiamo capito i dati scientifici e possiamo ridimensionarli, e non c’è motivo per cui questo tipo di modello non possa eguagliare le prestazioni dei modelli di livello di frontiera”, che hanno molti più parametri.

Information Labs afferma che Steerling-8B può raggiungere il 90% della capacità dei modelli esistenti, ma utilizza meno dati di addestramento, grazie alla sua nuova architettura. Il prossimo passo per l’azienda, nata da Y Combinator e che ha raccolto un spherical iniziale di 9 milioni di dollari da Inizialized Capital nel novembre 2024, è costruire un modello più ampio e iniziare a offrire accesso API e agenti agli utenti.

“Il modo in cui utilizziamo attualmente i modelli di addestramento è tremendous primitivo, quindi democratizzare l’interpretabilità intrinseca sarà in realtà una cosa positiva a lungo termine per il nostro ruolo all’interno della razza umana”, ha detto Adebayo a TechCrunch. “Mentre stiamo cercando questi modelli che saranno tremendous intelligenti, non vuoi che qualcosa prenda decisioni per tuo conto che sia un po’ misterioso per te.”