Il CEO di Open AI Sam Altman parla durante una sessione di conversazione con il CEO del gruppo SoftBank Masayoshi Son in occasione di un evento intitolato “Remodeling Enterprise by AI” a Tokyo, il 3 febbraio 2025.

Tomohiro Ohsumi | Immagini Getty

A novembre, dopo gli ultimi guadagni di Nvidia, il CEO Jensen Huang si è vantato con gli investitori della posizione della sua azienda nel campo dell’intelligenza artificiale e ha detto della startup più in voga nel settore: “Tutto ciò che OpenAI fa oggi gira su Nvidia”.

Sebbene sia vero che Nvidia mantiene una posizione dominante nei chip AI ed è ora l’azienda di maggior valore al mondo, la concorrenza sta emergendo e OpenAI sta facendo tutto il possibile per diversificarsi mentre persegue un piano di espansione storicamente aggressivo.

Mercoledì, OpenAI ha annunciato un accordo da 10 miliardi di dollari con il produttore di chip Cerebras, un attore relativamente nascente nel settore ma che punta al mercato pubblico. È stato l’ultimo di una serie di accordi tra OpenAI e le aziende che producono i processori necessari per costruire modelli linguistici di grandi dimensioni ed eseguire carichi di lavoro sempre più sofisticati.

L’anno scorso, OpenAI ha impegnato più di 1,4 trilioni di dollari in accordi infrastrutturali con aziende tra cui Nvidia, Microdispositivi avanzati E Broadcomin procinto di ottenere una valutazione del mercato privato di 500 miliardi di dollari.

Mentre OpenAI corre per soddisfare la domanda prevista per la sua tecnologia AI, ha segnalato al mercato che desidera tutta la potenza di elaborazione possibile. Ecco i principali accordi sui chip firmati da OpenAI a partire da gennaio e i potenziali associate da tenere d’occhio in futuro.

Nvidia

Il fondatore e CEO di Nvidia Jensen Huang parla durante Nvidia Dwell al CES 2026 in vista dell’annuale Client Electronics Present di Las Vegas, 5 gennaio 2026.

Patrick T. Fallon | Afp | Immagini Getty

Fin dai suoi inizi, costruendo modelli linguistici di grandi dimensioni, molto prima del lancio di ChatGPT e dell’inizio del increase dell’intelligenza artificiale generativa, OpenAI si è affidata alle unità di elaborazione grafica di Nvidia.

Nel 2025, quella relazione è passata a un altro livello. A seguito di un investimento in OpenAI alla advantageous del 2024, Nvidia ha annunciato a settembre che avrebbe impegnato 100 miliardi di dollari per supportare OpenAI mentre costruisce e distribuisce almeno 10 gigawatt di sistemi Nvidia.

Un gigawatt è una misura di potenza e 10 gigawatt equivalgono all’incirca al consumo energetico annuo di 8 milioni di famiglie statunitensi, secondo un’analisi della CNBC dei dati dell’Power Data Administration. Huang aveva dichiarato a settembre che 10 gigawatt equivarranno a tra i 4 e i 5 milioni di GPU.

“Questo è un progetto gigantesco”, disse all’epoca Huang alla CNBC.

OpenAI e Nvidia hanno affermato che la prima fase del progetto dovrebbe essere on-line nella seconda metà di quest’anno sulla piattaforma Vera Rubin di Nvidia. Tuttavia, durante la presentazione degli utili trimestrali di Nvidia a novembre, la società ha affermato che “non vi è alcuna garanzia” che il suo accordo con OpenAI andrà oltre l’annuncio e raggiungerà una fase contrattuale ufficiale.

Il primo investimento di Nvidia di 10 miliardi di dollari sarà effettuato quando il primo gigawatt sarà completato e gli investimenti saranno effettuati alle valutazioni attuali, come riportato in precedenza dalla CNBC.

AMD

Lisa Su, presidente e amministratore delegato di Superior Micro Units Inc., mostra una GPU AMD Intuition MI455X durante l’evento CES 2026 a Las Vegas, 5 gennaio 2026.

Bloomberg | Bloomberg | Immagini Getty

A ottobre, OpenAI ha annunciato l’intenzione di implementare sei gigawatt di GPU AMD nel corso di più anni e più generazioni di {hardware}.

Nell’ambito dell’accordo, AMD ha emesso un mandato per OpenAI per un massimo di 160 milioni di azioni ordinarie AMD, che potrebbero ammontare a circa il 10% delle azioni della società. Il mandato prevede l’acquisizione di traguardi legati sia al quantity di distribuzione che al prezzo delle azioni di AMD.

Le società hanno dichiarato di voler lanciare il primo gigawatt di chip nella seconda metà del 2026 e hanno aggiunto che l’accordo vale miliardi di dollari, senza rivelare un importo specifico.

“Sono necessarie partnership come questa che uniscano davvero l’ecosistema per garantire che, sai, possiamo davvero ottenere le migliori tecnologie, sai, là fuori”, ha detto alla CNBC Lisa Su, CEO di AMD, al momento dell’annuncio.

Altman ha piantato i semi per l’accordo a giugno, quando è apparso sul palco insieme a Su durante un evento di lancio di AMD a San Jose, in California. Ha detto che OpenAI prevede di utilizzare i chip più recenti di AMD.

Broadcom

L’amministratore delegato di Broadcom, Hock Tan.

Lucas Jackson | Reuters

Più tardi quel mese, OpenAI e Broadcom hanno svelato pubblicamente una collaborazione che period in cantiere da oltre un anno.

Broadcom chiama i suoi chip AI personalizzati XPU e finora si è affidata advert alcuni clienti. Ma la sua pipeline di potenziali accordi ha suscitato così tanto entusiasmo a Wall Avenue che Broadcom è ora valutata oltre 1,6 trilioni di dollari.

OpenAI ha affermato che sta progettando i propri chip e sistemi AI che saranno sviluppati e distribuiti da Broadcom. Le aziende hanno concordato di implementare 10 gigawatt di questi acceleratori IA personalizzati.

Nel comunicato di ottobre, le società hanno affermato che Broadcom mirerà a iniziare a implementare i rack dell’acceleratore AI e dei sistemi di rete entro la seconda metà di quest’anno, con l’obiettivo di completare il progetto entro la advantageous del 2029.

Ma il CEO di Broadcom, Hock Tan, ha detto agli investitori durante la conferenza sugli utili trimestrali della società a dicembre che non si aspetta molti ricavi dalla partnership OpenAI nel 2026.

“Apprezziamo il fatto che si tratti di un viaggio pluriennale che durerà fino al 2029”, ha affermato Tan. “Lo chiamo un accordo, un allineamento su dove siamo diretti.”

OpenAI e Broadcom non hanno rivelato i termini finanziari dell’accordo.

Cerebri

Andrew Feldman, co-fondatore e CEO di Cerebras Techniques, parla alla conferenza Collision a Toronto, il 20 giugno 2024.

Ramsey Cardy | File sportivo | Collisione | Immagini Getty

Mercoledì OpenAI ha annunciato un accordo per l’implementazione di 750 megawatt di chip AI di Cerebras che saranno disponibili in più tranche fino al 2028.

Secondo Cerebras costruisce chip di grandi dimensioni su scala wafer in grado di fornire risposte fino a 15 volte più veloci rispetto ai sistemi basati su GPU. una liberazione. L’azienda è molto più piccola di Nvidia, AMD e Broadcom.

L’accordo di OpenAI con Cerebras vale più di 10 miliardi di dollari e potrebbe essere un vantaggio per il produttore di chip in quanto valuta un potenziale debutto sui mercati pubblici.

“Siamo lieti di collaborare con OpenAI, portando i modelli di intelligenza artificiale chief a livello mondiale nel processore di intelligenza artificiale più veloce del mondo”, ha affermato in una nota il CEO di Cerebras Andrew Feldman.

Cerebras ha un disperato bisogno di clienti tendoni. Nel mese di ottobre, l’azienda ritirato piani per una IPO, pochi giorni dopo aver annunciato di aver raccolto oltre 1 miliardo di dollari in un spherical di raccolta fondi. Aveva presentato istanza di offerta pubblica un anno prima, ma il suo prospetto rivelava una forte dipendenza da un unico cliente negli Emirati Arabi Uniti, G42 sostenuto da Microsoft, che è anche un investitore di Cerebras.

Potenziali associate

Sam Altman, CEO di OpenAI, parla durante un tour mediatico del knowledge heart Stargate advert Abilene, Texas, il 23 settembre 2025. Stargate è una collaborazione di OpenAI, Oracle e SoftBank, con il supporto promozionale del presidente Donald Trump, per costruire knowledge heart e altre infrastrutture per l’intelligenza artificiale in tutti gli Stati Uniti

Kyle Grillot | Bloomberg | Immagini Getty

Dove va a finire? Amazzonia, Google e Intel, che hanno tutti i propri giochi di chip AI?

A novembre, OpenAI ha firmato un accordo cloud da 38 miliardi di dollari Servizi Internet di Amazon. OpenAI eseguirà i carichi di lavoro attraverso i knowledge heart AWS esistenti, ma il fornitore di servizi cloud prevede anche di costruire un’infrastruttura aggiuntiva per la startup come parte dell’accordo.

Amazon è anche in trattative per investire potenzialmente più di 10 miliardi di dollari in OpenAI, come riportato in precedenza dalla CNBC.

OpenAI potrebbe decidere di utilizzare i chip AI di Amazon nell’ambito di queste discussioni sugli investimenti, ma non è stato accertato nulla di ufficiale, secondo una persona a conoscenza della questione che ha chiesto di restare anonima perché le discussioni sono confidenziali.

AWS ha annunciato i suoi chip Inferentia nel 2018 e l’ultima generazione dei suoi chip Trainium alla advantageous del 2025.

GoogleNuvola fornisce a OpenAI anche capacità di calcolo grazie advert un accordo concluso in sordina lo scorso anno. Ma OpenAI disse a giugno che non ha intenzione di utilizzare i chip interni di Google chiamati unità di elaborazione tensore, che Broadcom aiuta anche a produrre.

Intel è stata il più grande ritardatario dell’intelligenza artificiale tra i produttori di chip tradizionali, il che spiega perché la società ha recentemente investito ingenti investimenti da parte del governo degli Stati Uniti e di Nvidia. Reuters segnalato nel 2024, citando persone a conoscenza delle discussioni, che Intel aveva avuto la possibilità di investire in OpenAI anni prima e potenzialmente realizzare {hardware} per l’allora neonata startup, offrendole un modo per evitare la dipendenza da Nvidia.

Intel ha deciso contro l’accordo, secondo Reuters.

Nel mese di ottobre, Intel annunciato una nuova GPU per knowledge heart che ha nome in codice Crescent Island e che afferma essere “progettata per soddisfare le crescenti esigenze dei carichi di lavoro di inferenza AI e offrirà un’elevata capacità di memoria e prestazioni advert alta efficienza energetica”. La società ha affermato che il “campionamento dei clienti” è previsto nella seconda metà del 2026.

Wall Avenue riceverà aggiornamenti sugli ultimi sforzi di Intel nel campo dell’intelligenza artificiale quando la società darà il through alla stagione degli utili tecnologici la prossima settimana.

— Kif Leswing, MacKenzie Sigalos e Jordan Novet della CNBC hanno contribuito a questo rapporto.

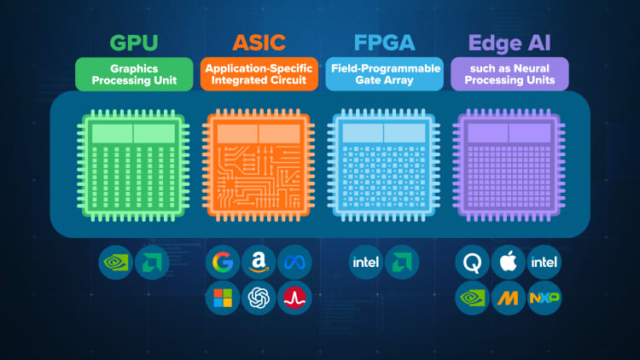

OROLOGIO: Analizzare i chip AI, dalle GPU Nvidia agli ASIC di Google e Amazon