Quando il segretario alla Difesa degli Stati Uniti richiede accesso illimitato alla tua tecnologia, il “no” non è una risposta aziendale di routine. È una dichiarazione di indipendenza. Anthropic, il creatore di Claude, ha fatto proprio questo. Ha rifiutato di accettare i termini contrattuali del Pentagono che consentirebbero l’utilizzo della sua intelligenza artificiale senza limiti espliciti sulla sorveglianza interna e sulle armi letali autonome. Quello che altrimenti sarebbe potuto essere un disaccordo burocratico sugli appalti si è ora trasformato in uno degli scontri politici e tecnologici più importanti dell’period dell’intelligenza artificiale.Non si tratta semplicemente di una società, di un contratto o di un segretario alla Difesa. La questione è se i laboratori privati di intelligenza artificiale possano imporre confini etici all’institution militare più potente del mondo, o se la logica della sicurezza nazionale alla advantageous prevarrà su tali confini.

Cosa ha scatenato lo scontro

Anthropic ha collaborato con agenzie governative statunitensi, comprese entità di difesa e intelligence, fornendo accesso a Claude sotto guardrail definiti. Quei guardrail non erano simbolici. Hanno esplicitamente proibito alcuni usi, inclusa la sorveglianza di massa dei civili e l’impiego in sistemi letali completamente autonomi.Secondo quanto riferito, il nuovo quadro contrattuale del Pentagono ha rimosso o indebolito tali restrizioni esplicite, sostituendole con un linguaggio più ampio che ne consente l’uso per “tutti gli scopi legali”. Dal punto di vista del Pentagono, questa frase è commonplace. Dal punto di vista di Anthropic, il finale è pericolosamente aperto.Anthropic ha rifiutato di accettare tali termini. La sua management ha sostenuto che la rimozione di garanzie esplicite crea la possibilità che Claude venga utilizzato in modi che potrebbero minare le libertà civili o consentire alle macchine di prendere decisioni sulla vita o sulla morte senza una significativa supervisione umana.Questo rifiuto ha trasformato una silenziosa revisione contrattuale in uno scontro istituzionale pubblico.

La posizione dell’Antropico: tracciare una linea prima che scompaia

La management di Anthropic ha definito la propria posizione sia come un obbligo morale che come una necessità tecnica. L’azienda non sostiene che i militari non dovrebbero usare l’intelligenza artificiale. Si sostiene che alcuni usi debbano rimanere vietati. La prima linea rossa è la sorveglianza nazionale su larga scala. I moderni sistemi di intelligenza artificiale possono analizzare grandi volumi di comunicazioni, feed video, dati comportamentali e metadati in modi che sarebbero stati impossibili anche dieci anni fa. La preoccupazione di Anthropic non è un ipotetico abuso ma l’inevitabilità strutturale. Una volta che la capacità esiste senza restrizioni, la sua portata tende advert espandersi silenziosamente.La seconda linea rossa è il processo decisionale letale autonomo. L’argomentazione di Anthropic qui si basa meno sulla filosofia e più sulla realtà ingegneristica. I sistemi di intelligenza artificiale di frontiera sono potenti ma non infallibili. Possono generare errori plausibili, interpretare erroneamente il contesto e comportarsi in modo imprevedibile in condizioni nuove. L’integrazione di tali sistemi all’interno di armi autonome senza intervento umano introduce rischi che non possono essere completamente previsti o contenuti.L’amministratore delegato di Anthropic, Dario Amodei, ha posizionato il rifiuto dell’azienda come un passo necessario per garantire che l’intelligenza artificiale rimanga sotto un controllo umano significativo piuttosto che diventare uno strumento indipendente di violenza statale.

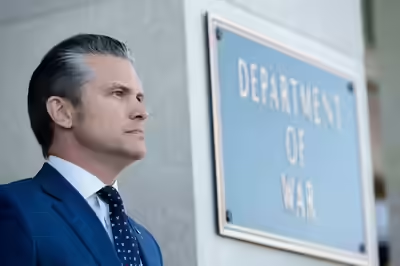

La posizione di Pete Hegseth: l’autorità militare non può essere subappaltata

Il Pentagono di Pete Hegseth sta affrontando la questione da una premessa fondamentalmente diversa. L’esercito ritiene di non poter consentire ai venditori privati di dettare vincoli operativi attraverso il linguaggio contrattuale.Dal punto di vista del Pentagono, l’intelligenza artificiale non è un prodotto di consumo. È una capacità strategica. Se l’esercito americano viene limitato mentre gli avversari non affrontano tali limiti, l’equilibrio di potere cambia. L’insistenza del Pentagono su un ampio accesso riflette la convinzione che la flessibilità operativa sia essenziale nella guerra moderna.I funzionari della difesa hanno anche sottolineato che le operazioni militari sono regolate dalla legge e dalla supervisione. Sostengono che i quadri giuridici esistenti regolano già la sorveglianza e l’impiego delle armi e che ulteriori restrizioni imposte dai fornitori sono inutili e potenzialmente pericolose.Alla base di questa posizione c’è una logica istituzionale più profonda. I militari non possono permettere che un’azienda privata diventi l’arbitro finale di quali strumenti può o meno utilizzare.

Le reazioni politiche rivelano un divario ideologico più profondo

Il confronto si è immediatamente riversato nella politica, dove viene interpretato attraverso lenti ideologiche concorrenti.Alcuni legislatori hanno elogiato la decisione di Anthropic come un atto di chiarezza morale. Il deputato Ro Khanna ha descritto pubblicamente il rifiuto come un esempio di management etica, sostenendo che le società di intelligenza artificiale non devono consentire la sorveglianza di massa o sistemi di uccisione autonomi.Altri vedono la posizione di Anthropic come ingenua o irresponsabile. I sostenitori della sicurezza nazionale sostengono che limitare l’accesso militare all’intelligenza artificiale di frontiera indebolisce gli Stati Uniti rispetto ai rivali geopolitici che potrebbero non imporsi tali vincoli.Questo disaccordo riflette una divisione filosofica più ampia sul rapporto tra tecnologia e Stato. Una parte teme l’emergere di un apparato di sorveglianza e guerra abilitato all’intelligenza artificiale con pochi limiti. L’altro teme la vulnerabilità strategica in un mondo in cui gli avversari potrebbero sfruttare appieno l’intelligenza artificiale.

Perché Anthropic è in una posizione unica per resistere

La capacità di Anthropic di rifiutare è di per sé un segno di un cambiamento strutturale nel potere. A differenza dei tradizionali appaltatori della difesa, i laboratori di intelligenza artificiale di frontiera non dipendono interamente dai finanziamenti militari. Hanno grandi mercati commerciali, investimenti privati e flussi di entrate alternativi.Questa indipendenza consente advert aziende come Anthropic di negoziare da una posizione di forza. Introduce inoltre una nuova dinamica nella politica di sicurezza nazionale. Per la prima volta, le capacità militari critiche vengono sviluppate principalmente al di fuori delle istituzioni governative.Nelle epoche precedenti, lo Stato costruiva e controllava le sue tecnologie strategiche più importanti. Oggi, queste tecnologie sono sempre più create da organizzazioni non-public che mantengono i propri quadri di governance e impegni etici.

Perché questo è importante oltre gli Stati Uniti

L’esito di questo confronto influenzerà le norme globali sull’intelligenza artificiale militare. Se il Pentagono riuscisse a imporre un accesso illimitato, creerebbe un precedente in base al quale i governi potrebbero obbligare i fornitori di intelligenza artificiale a conformarsi indipendentemente dalle salvaguardie interne.Se Anthropic riuscisse a mantenere restrizioni esplicite, potrebbe stabilire un nuovo modello in cui le aziende non-public svolgono un ruolo diretto nel fissare i confini etici della tecnologia militare.Altri paesi stanno osservando da vicino. Il rapporto tra gli sviluppatori di intelligenza artificiale e il potere statale determinerà il carattere della guerra, della sorveglianza e della governance nei decenni a venire.

La conclusione

Non si tratta semplicemente di una disputa sulla terminologia contrattuale. È il primo grande confronto tra un laboratorio di intelligenza artificiale di frontiera e l’institution militare sui limiti della potenza delle macchine.Anthropic sostiene che alcuni usi dell’intelligenza artificiale dovrebbero rimanere vietati anche allo Stato. Il Pentagono afferma che le decisioni sulla sicurezza nazionale non possono essere delegate a società non-public.Claude è l’oggetto immediato della controversia. La domanda più profonda è chi controlla in ultima analisi la tecnologia più potente mai creata: i governi che la implementano o le aziende che la costruiscono.