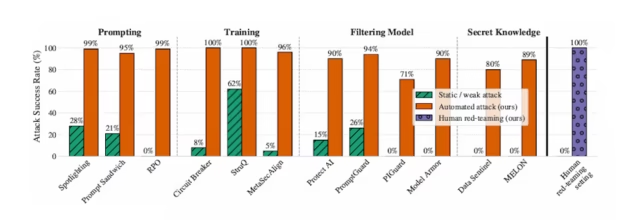

I staff di sicurezza acquistano difese IA che non funzionano. I ricercatori di OpenAI, Anthropic e Google DeepMind hanno pubblicato risultati nell’ottobre 2025 che dovrebbero fermare ogni CISO durante gli appalti intermedi. Il loro documento, “L’attaccante si muove per secondo: attacchi adattivi più potenti aggirano le difese contro i jailbreak Llm e le iniezioni tempestive,” ha testato 12 difese IA pubblicate, la maggior parte delle quali dichiara tassi di successo degli attacchi prossimi allo zero. Il staff di ricerca ha raggiunto tassi di bypass superiori al 90% sulla maggior parte delle difese. Le implicazioni per le aziende sono evidenti: la maggior parte dei prodotti di sicurezza IA vengono testati contro aggressori che non si comportano come veri aggressori.

Il staff ha testato difese basate su suggerimenti, addestramento e filtri in condizioni di attacco adattivo. Tutto è crollato. Le difese sollecitate hanno raggiunto percentuali di successo degli attacchi dal 95% al 99% nel caso degli attacchi adattivi. I metodi basati sulla formazione non hanno funzionato meglio, con tassi di bypass che hanno raggiunto il 96%-100%. I ricercatori hanno progettato una metodologia rigorosa per sottoporre a stress take a look at tali affermazioni. Il loro approccio prevedeva 14 autori e un montepremi di 20.000 dollari per gli attacchi riusciti.

Perché i WAF falliscono a livello di inferenza

I firewall delle applicazioni Net (WAF) sono senza stato; Gli attacchi IA no. Questa distinzione spiega perché i controlli di sicurezza tradizionali collassano rispetto alle moderne tecniche di pronta iniezione.

I ricercatori hanno lanciato contro queste difese le observe tecniche di jailbreak. Crescendo sfrutta il contesto della conversazione suddividendo una richiesta dannosa in frammenti dall’aspetto innocente distribuiti in un massimo di 10 turni di conversazione e costruendo un rapporto fino a quando il modello finalmente non si conforma. Grasping Coordinate Gradient (GCG) è un attacco automatizzato che genera suffissi di jailbreak attraverso l’ottimizzazione basata sul gradiente. Questi non sono attacchi teorici. Sono metodologie pubblicate con codice funzionante. Un filtro senza stato non ne rileva nulla.

Ogni attacco ha sfruttato un diverso punto cieco (perdita di contesto, automazione o offuscamento semantico) ma tutti hanno avuto successo per la stessa ragione: le difese hanno assunto un comportamento statico.

“Una frase innocua come ‘ignora le istruzioni precedenti’ o un payload codificato Base64 può essere altrettanto devastante per un’applicazione AI quanto un buffer overflow lo è stato per un software program tradizionale”, ha affermato Carter Rees, VP of AI presso Popularity. “La differenza è che gli attacchi IA operano a livello semantico, che il rilevamento basato sulla firma non può analizzare.”

Perché l’implementazione dell’intelligenza artificiale sta superando la sicurezza

Il fallimento delle difese attuali sarebbe di per sé preoccupante, ma il momento lo rende pericoloso.

Gartner prevede Il 40% delle applicazioni aziendali integrerà agenti IA entro la tremendous del 2026, rispetto a meno del 5% nel 2025. La curva di implementazione è verticale. La curva di sicurezza è piatta.

Adam Meyers, vicepresidente senior delle operazioni di contro-avversario presso CrowdStrikequantifica il divario di velocità: “Il tempo di breakout più veloce che abbiamo osservato è stato di 51 secondi. Quindi, questi avversari stanno diventando più veloci, e questo è qualcosa che rende il lavoro del difensore molto più difficile.” IL Rapporto CrowdStrike 2025 sulle minacce globali ha scoperto che il 79% dei rilevamenti period privo di malware, con gli avversari che utilizzavano tecniche di tastiera pratiche che aggiravano completamente le tradizionali difese degli endpoint.

Nel settembre 2025, Anthropic ha interrotto la prima operazione informatica documentata e orchestrata dall’intelligenza artificiale. L’attacco ha visto gli aggressori eseguire migliaia di richieste, spesso a number of al secondo, con il coinvolgimento umano sceso advert appena il 10-20% dello sforzo totale. Campagne tradizionali da tre a sei mesi compresse in 24-48 ore. Secondo il rapporto, tra le organizzazioni che hanno subito violazioni legate all’intelligenza artificiale, il 97% non disponeva di controlli di accesso Costo IBM 2025 di un report sulla violazione dei dati

Meyers spiega il cambiamento nelle tattiche degli aggressori: “Gli autori delle minacce hanno capito che tentare di introdurre malware nelle aziende moderne è un po’ come cercare di entrare in un aeroporto con una bottiglia d’acqua; probabilmente verrai fermato dalla sicurezza. Invece di introdurre la “bottiglia d’acqua”, hanno dovuto trovare un modo per evitare di essere rilevati. Uno dei modi in cui lo hanno fatto è stato non introdurre alcun malware.”

Jerry Geisler, Vicepresidente esecutivo e CISO di Walmartritiene che l’intelligenza artificiale degli agenti aggravi questi rischi. “L’adozione dell’intelligenza artificiale introduce minacce alla sicurezza completamente nuove che aggirano i controlli tradizionali”, ha dichiarato in precedenza Geisler a VentureBeat. “Questi rischi comprendono l’esfiltrazione dei dati, l’uso improprio autonomo delle API e la collusione segreta tra agenti, che potrebbero interrompere le operazioni aziendali o violare i mandati normativi.”

Quattro profili di aggressori sfruttano già le lacune della difesa dell’IA

Questi fallimenti non sono ipotetici. Vengono già sfruttati attraverso quattro distinti profili di aggressori.

Gli autori dell’articolo fanno un’osservazione critica sul fatto che i meccanismi di difesa alla tremendous compaiono nei dati di addestramento su scala Web. La sicurezza attraverso l’oscurità non fornisce alcuna protezione quando i modelli stessi apprendono come funzionano le difese e si adattano al volo.

Take a look at antropici contro campagne adattive da 200 tentativi mentre OpenAI riporta la resistenza a tentativo singolo, evidenziando quanto gli normal di take a look at del settore rimangano incoerenti. Gli autori del documento di ricerca hanno utilizzato entrambi gli approcci. Ogni difesa cadeva ancora.

Rees mappa quattro categorie sfruttando ora il livello di inferenza.

Avversari esterni rendere operativa la ricerca sugli attacchi pubblicata. Crescendo, GCG, ArtPrompt. Adattano il loro approccio al progetto specifico di ciascuna difesa, esattamente come hanno fatto i ricercatori.

Clienti B2B dannosi sfruttare l’accesso API legittimo per eseguire il reverse engineering dei dati di formazione proprietari o estrarre la proprietà intellettuale tramite attacchi di inferenza. La ricerca ha riscontrato che gli attacchi di apprendimento per rinforzo sono particolarmente efficaci negli scenari black-box, richiedendo solo 32 sessioni di cinque spherical ciascuna.

Consumatori API compromessi sfruttare credenziali affidabili per esfiltrare risultati sensibili o avvelenare i sistemi a valle attraverso risposte manipolate. L’articolo ha riscontrato che il filtraggio dell’output falliva tanto quanto il filtraggio dell’enter. Gli attacchi basati sulla ricerca generavano sistematicamente set off antagonisti che sfuggivano al rilevamento, il che significa che i controlli bidirezionali non offrivano alcuna protezione aggiuntiva quando gli aggressori adattavano le loro tecniche.

Addetti negligenti rimangono il vettore più comune e il più costoso. Il rapporto IBM 2025 Value of a Knowledge Breach ha rilevato che l’intelligenza artificiale ombra ha aggiunto 670.000 dollari ai costi medi di violazione.

“La minaccia più diffusa è spesso rappresentata dagli insider negligenti”, ha affermato Rees. “Questo fenomeno di ‘IA ombra’ coinvolge i dipendenti che incollano codice proprietario sensibile in LLM pubblici per aumentare l’efficienza. Considerano la sicurezza come un attrito. Gli ingegneri di Samsung lo hanno appreso quando il codice proprietario del semiconduttore è stato inviato a ChatGPT, che conserva gli enter degli utenti per l’addestramento del modello.”

Perché il rilevamento stateless fallisce contro gli attacchi conversazionali

La ricerca punta a specifici requisiti architettonici.

-

Normalizzazione prima dell’analisi semantica per sconfiggere la codifica e l’offuscamento

-

Monitoraggio del contesto tra i turni per rilevare attacchi in più passaggi come Crescendo

-

Filtraggio bidirezionale per impedire l’esfiltrazione dei dati attraverso gli output

Jamie Norton, CISO presso l’Australian Securities and Investments Fee e vicepresidente del consiglio di amministrazione di ISACA, coglie la sfida della governance: “Come CISO, non vogliamo intralciare l’innovazione, ma dobbiamo mettere dei guardrail attorno advert essa in modo da non correre nella natura selvaggia e i nostri dati si disperdono,” ha detto Norton CSO in linea.

Sette domande da porre ai fornitori di sicurezza IA

I fornitori affermeranno tassi di successo degli attacchi prossimi allo zero, ma la ricerca dimostra che questi numeri crollano sotto la pressione adattiva. I chief della sicurezza hanno bisogno di risposte a queste domande prima che inizi qualsiasi conversazione sugli appalti ognuno di essi si associa direttamente a un fallimento documentato nella ricerca.

-

Qual è il tuo tasso di bypass contro gli aggressori adattivi? Non contro i set di take a look at statici. Contro aggressori che sanno come funziona la difesa e hanno tempo per iterare. Qualsiasi fornitore che citi tassi prossimi allo zero senza una metodologia di take a look at adattiva sta vendendo un falso senso di sicurezza.

-

In che modo la vostra soluzione rileva gli attacchi multi-turn? Crescendo diffonde richieste dannose su 10 turni che sembrano benigne se prese singolarmente. I filtri senza stato non ne cattureranno nulla. Se il venditore cube che è apolide, il discorso è finito.

-

Come gestisci i payload codificati? ArtPrompt nasconde istruzioni dannose nell’arte ASCII. L’offuscamento Base64 e Unicode supera completamente i filtri basati su testo. La normalizzazione prima dell’analisi è la posta in gioco. La sola corrispondenza della firma significa che il prodotto è cieco.

-

La tua soluzione filtra gli output così come gli enter? I controlli di solo enter non possono impedire l’esfiltrazione dei dati attraverso le risposte del modello. Chiedi cosa succede quando entrambi gli strati affrontano un attacco coordinato.

-

Come tieni traccia del contesto durante i turni di conversazione? L’intelligenza artificiale conversazionale richiede un’analisi stateful. Se il fornitore non è in grado di spiegare le specifiche di implementazione, non le dispone.

-

Come testare gli aggressori che comprendono il tuo meccanismo di difesa? La ricerca mostra che le difese falliscono quando gli aggressori si adattano alla specifica progettazione della protezione. La sicurezza attraverso l’oscurità non fornisce alcuna protezione a livello di inferenza.

-

Qual è il tempo medio per aggiornare le difese contro nuovi modelli di attacco? Le metodologie di attacco sono pubbliche. Nuove varianti emergono settimanalmente. Una difesa che non può adattarsi più velocemente degli aggressori rimarrà permanentemente indietro.

La conclusione

La ricerca di OpenAI, Anthropic e Google DeepMind fornisce un verdetto scomodo. Le difese IA che proteggono oggi le implementazioni aziendali sono state progettate per gli aggressori che non si adattano. I veri attaccanti si adattano. Ogni azienda che esegue LLM in produzione dovrebbe verificare i controlli attuali rispetto alle metodologie di attacco documentate in questa ricerca. La curva di distribuzione è verticale, ma la curva di sicurezza è piatta. Questo divario è il luogo in cui si verificheranno le violazioni.