Con un’impresa impressionante, la startup giapponese Sakana AI’s agente di codifica ALE-Agente recentemente si è assicurato il primo posto nell’AtCoder Heuristic Contest (AHC058), una complessa competizione di codifica che comporta complicati problemi di ottimizzazione – e una sfida più difficile e forse significativa rispetto a benchmark come HumanEval, che mettono alla prova principalmente la capacità di scrivere funzioni isolate e che molti modelli e agenti di intelligenza artificiale ora superano regolarmente con facilità (“saturazione del benchmark”).

Quello di Sakana I risultati raggiunti con ALE-Agent suggeriscono uno spostamento verso agenti in grado di ottimizzarsi autonomamente per navigare e funzionare bene in sistemi complessi e dinamici come stack di software program aziendali, flussi di lavoro e ambienti operativi.

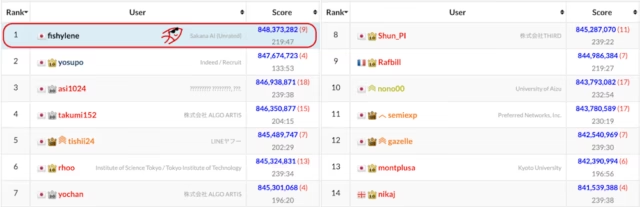

In quattro ore, l’agente ha utilizzato il ridimensionamento del tempo di inferenza per generare, testare e ripetere centinaia di soluzioni, risolvendo un problema che in genere richiede un’intuizione profonda e tentativi ed errori dispendiosi in termini di tempo da parte di esperti umani. Ha sovraperformato oltre 800 partecipanti umani, inclusi programmatori competitivi di alto livello.

Come funziona ALE-Agent

La sfida in AHC058 period un classico ottimizzazione combinatoria problema. I partecipanti avevano il compito di gestire un insieme di macchine con relazioni gerarchiche, come macchine che producono mele e altre macchine che costruiscono quelle macchine produttrici di mele. L’obiettivo period massimizzare la produzione su un numero fisso di turni.

Nel mondo aziendale, questo flusso di lavoro segue solitamente uno schema rigoroso: un esperto di dominio lavora con un cliente per definire una “funzione obiettivo” (nota anche come Scorer), quindi gli ingegneri costruiscono un sistema software program per ottimizzarlo. Questi problemi sono notoriamente difficili perché non possono essere risolti in un’unica fase. Richiedono esplorazione, strategia e capacità di cambiare direzione quando un piano non funziona.

Gli esperti umani in genere affrontano questo problema utilizzando una strategia in due fasi. Innanzitutto, utilizzano un metodo “Grasping” (un risolutore leggero che effettua la scelta migliore immediata in ogni passaggio) per generare una soluzione di base decente. Poi si applicano”ricottura simulata,” una tecnica che prende il piano esistente e apporta piccoli aggiustamenti casuali per vedere se il punteggio migliora. Tuttavia, questo approccio customary è rigido. Se il piano Grasping iniziale va nella direzione sbagliata, la ricottura simulata raramente può risolverlo perché cerca solo miglioramenti locali in un’space difettosa dello spazio della soluzione.

L’innovazione di ALE-Agent è stata quella di trasformare questo strumento di inizializzazione statico in un motore di ricostruzione dinamica. Invece di fare affidamento sul valore immediato, l’agente ha derivato in modo indipendente un concetto chiamato “potere virtuale”. Assegnava valore a componenti non ancora operativi, trattandoli come se già possedessero valore. Valutando le attività potenziali future anziché solo quelle attuali, l’agente ha capitalizzato sull'”effetto dell’interesse composto”, un concetto esplicitamente identificato nella sua registri interni. In sostanza, potrebbe guardare qualche passo avanti e ragionare sul futuro invece di guardare al suggestions immediato che riceve dal suo ambiente.

Fondamentalmente, l’agente doveva mantenere questa strategia per un periodo di quattro ore senza perdere la concentrazione, una modalità di fallimento comune nota come “deriva del contesto”. Nei commenti forniti a VentureBeat, il group AI di Sakana ha spiegato che l’agente genera “intuizioni” testuali riflettendo su ogni prova. Raccoglie queste conoscenze per evitare di tornare a strategie precedentemente fallite e crea una memoria di lavoro che gli consente di guardare qualche passo avanti anziché limitarsi a reagire al suggestions immediato.

Inoltre, l’agente ha integrato i metodi Grasping direttamente nella fase di ricottura simulata per evitare di rimanere bloccati nell’ottimale locale, utilizzando la ricostruzione advert alta velocità per eliminare e ricostruire al volo ampie sezioni della soluzione.

Dalla codifica all’ottimizzazione aziendale

Questa innovazione si inserisce direttamente nei flussi di lavoro aziendali esistenti in cui è già disponibile una funzione di punteggio. Attualmente, le aziende si affidano a scarsi talenti ingegneristici per scrivere algoritmi di ottimizzazione. ALE-Agent dimostra un futuro in cui gli esseri umani definiscono il “Segnatore” (ovvero la logica aziendale e gli obiettivi) e l’agente gestisce l’implementazione tecnica.

Ciò sposta il collo di bottiglia operativo dalla capacità ingegneristica alla chiarezza metrica. Se un’impresa può misurare un obiettivo, l’agente può ottimizzarlo. Ciò ha applicazioni dirette nella logistica, come il routing dei veicoli, nonché il bilanciamento del carico dei server e l’allocazione delle risorse.

Secondo il group AI di Sakana, ciò potrebbe democratizzare l’ottimizzazione. “Consente un futuro in cui i clienti non tecnici possono interagire direttamente con l’agente, modificando i vincoli aziendali in tempo reale finché non ottengono l’output desiderato”, hanno affermato.

Il group AI di Sakana ha dichiarato a VentureBeat che ALE-Agent è attualmente proprietario e non disponibile per l’uso pubblico, e che la società è attualmente focalizzata sullo sviluppo interno e sulle collaborazioni di prova di concetto con le imprese.

Allo stesso tempo, il group sta già guardando avanti alla “riscrittura automatica” degli agenti. Questi futuri agenti potrebbero definire i propri marcatori, rendendoli fattibili per problemi mal definiti in cui gli esperti umani faticano a formulare parametri iniziali chiari.

Il costo dell’intelligence

Eseguire ALE-Agent non period economico. L’operazione di quattro ore ha comportato circa 1.300 dollari in costi di elaborazione che hanno coinvolto oltre 4.000 chiamate di ragionamento a modelli come GPT-5.2 E Gemelli 3 Professional. Sebbene questo prezzo possa sembrare elevato per una singola attività di codifica, il ritorno sull’investimento per i problemi di ottimizzazione è spesso asimmetrico. In un contesto di gestione delle risorse, un costo una tantum di poche migliaia di dollari può comportare milioni di dollari di risparmi annuali in termini di efficienza.

Tuttavia, le imprese che prevedono semplicemente una riduzione dei costi potrebbero non cogliere il quadro strategico. Mentre il costo dei token sta diminuendo, la spesa totale potrebbe effettivamente aumentare poiché le aziende competono per risposte migliori, un concetto noto come Il paradosso di Jevons.

“Mentre algoritmi più intelligenti favoriranno l’efficienza, il valore principale dell’intelligenza artificiale è la sua capacità di esplorare vasti spazi di soluzioni”, ha affermato il group Sakana AI. “Man mano che i costi di inferenza diminuiscono, invece di limitarsi a incassare i risparmi, le aziende probabilmente sceglieranno di sfruttare story convenienza per condurre ricerche ancora più approfondite e più ampie per trovare soluzioni superiori.”

L’esperimento evidenzia l’immenso valore ancora da sbloccare attraverso tecniche di ridimensionamento del tempo di inferenza. Man mano che i sistemi di intelligenza artificiale acquisiscono la capacità di gestire compiti di ragionamento complessi in contesti più lunghi, la costruzione di impalcature migliori e l’allocazione di price range maggiori per il “tempo di riflessione” consente agli agenti di rivaleggiare con i migliori esperti umani.