Negli ultimi due anni, la logica prevalente nell’intelligenza artificiale generativa è stata quella della forza bruta: se vuoi ragionare meglio, hai bisogno di un modello più grande.

Sebbene i modelli “piccoli” (sotto i 10 miliardi di parametri) siano diventati abili conversatori, storicamente si sono sgretolati quando è stato loro chiesto di eseguire deduzioni logiche in più passaggi o dimostrazioni matematiche complesse.

Oggi, il Know-how Innovation Institute (TII) di Abu Dhabi sta sfidando questa legge di ridimensionamento il rilascio del Falcon H1R 7B.

Abbandonando la pura ortodossia del Transformer in favore di un’architettura ibrida, TII afferma di aver costruito un modello da 7 miliardi di parametri che non solo rivaleggia ma supera i concorrenti di quasi 7 volte le sue dimensioni, comprese le varianti 32B e 47B di Qwen di Alibaba e Nemotron di Nvidia.

Il rilascio segna un cambiamento significativo nell’ecosistema open-weight, spostando il campo di battaglia dal conteggio dei parametri grezzi all’efficienza dell’architettura e al ridimensionamento dei tempi di inferenza.

Il pieno il codice del modello è ora disponibile su Hugging Face e può essere testato da individui in un’inferenza demo dal vivo su Falcon Chat (un’esperienza di chatbot). TII ha inoltre rilasciato un programma apparentemente abbastanza completo relazione tecnica anche sulla metodologia di avvicinamento e addestramento del Falcon H17B.

Andare oltre la tecnologia LLM fondamentale, il trasformatore

La caratteristica distintiva del Falcon H1R 7B è la sua dorsale “ibrida”. La maggior parte dei LLM moderni si basa esclusivamente sull’architettura Transformer, che si adatta in modo prevedibile ma soffre di elevati costi di memoria durante l’elaborazione di lunghe sequenze.

Falcon H1R 7B integra Mamba, un’architettura state-space mannequin (SSM), insieme ai livelli di attenzione normal di Transformer.

Originariamente sviluppato dai ricercatori Albert Gu e Tri Dao della Carnegie Mellon College e dell’Università di Princeton, Mamba è stato introdotto per la prima volta nel documento “Mamba: modellazione di sequenze temporali lineari con spazi di stati selettivi” pubblicato il 1 dicembre 2023.

L’architettura elabora le sequenze di dati in modo diverso rispetto a Transformers: mentre Transformers confronta ogni dato con ogni altro pezzo (scaling quadratico), Mamba elabora i token in sequenza, consentendogli di gestire grandi quantità di informazioni con ridimensionamento lineare e costi di elaborazione significativamente ridotti.

Questa combinazione risolve uno dei colli di bottiglia più persistenti nell’implementazione dei modelli di ragionamento: il costo del “pensare”. I modelli di ragionamento richiedono la generazione di lunghe “catene di pensiero” – monologhi interni passo dopo passo – prima di arrivare a una risposta. Per i Transformers normal, questi lunghi contesti fanno esplodere i costi computazionali.

Secondo il rapporto tecnico di TII, l’approccio ibrido consente al Falcon H1R 7B di mantenere un rendimento elevato anche quando la lunghezza della risposta aumenta. Con una dimensione batch di 64, il modello elabora circa 1.500 token al secondo per GPU, quasi il doppio della velocità del modello concorrente Qwen3 8B.

Prestazioni di riferimento: punching up

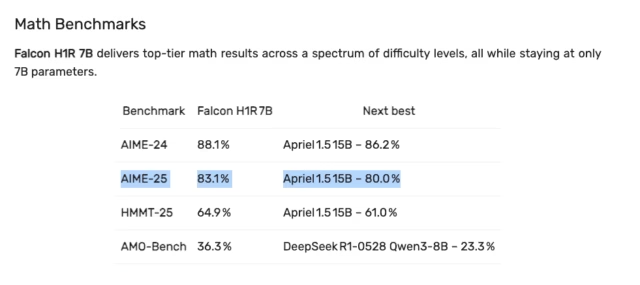

Nei benchmark pubblicati da TII, la disparità tra le dimensioni del Falcon H1R 7B e le sue prestazioni è netta. Su AIME 2025 classifica: un take a look at rigoroso di ragionamento matematico: il Falcon H1R 7B ha ottenuto un punteggio 83,1%un risultato che sconvolge la tradizionale gerarchia del dimensionamento del modello.

Mentre il modello 7B segue naturalmente enormi frontiere proprietarie come GPT-5.2 (99,0%) e Gemelli 3Flash (97,0%) sul indice di analisi artificiale separato (gestito dall’omonima organizzazione indipendente, che non ha ancora effettuato il benchmarking del Falcon H1R 7B), ha effettivamente colmato il divario tra pesi aperti “efficienti” e sistemi proprietari di medio livello.

-

Battere i “pensatori” più grandi: Falcon H1R 7B (83,1%) supera il parametro di 15 miliardi Apriel-v1.6-Pensatore (82,7%) e il parametro di 32 miliardi OLMo 3 Pensa (73,7%), confermando l’affermazione di TII secondo cui le architetture ibride possono superare i Transformer più grandi.

-

Inseguendo i chief proprietari: Si trova a una distanza impressionante da Claude 4.5 Sonetto (88,0%) e Amazon Nova 2.0 Lite (88,7%), suggerendo che per specifici flussi di lavoro advert alto contenuto matematico, questo modello 7B è un’alternativa praticabile e a bassa latenza alle costose API commerciali.

-

Superare i giganti della tradizione: Su questo specifico parametro di ragionamento, batte decisamente architetture ampiamente capaci ma più vecchie Mistral Grande 3 (38,0%) e Lama 4 Maverick (19,3%), evidenziando come la formazione specializzata sul ragionamento (“Deep Suppose”) sia diventata più critica rispetto alla scala grezza per i compiti di logica.

Altre vittorie chiave nel dominio includono:

-

Codifica: Il modello raggiunto 68,6% sul benchmark LCB v6, il punteggio dichiarato da TII è il più alto tra tutti i modelli testati, compresi quelli quattro volte più grandi.

-

Ragionamento generale: Sebbene domini in matematica e programmazione, il suo punteggio nel ragionamento generale (49,48%) rimane competitivo, collocandosi appena al di sotto dei modelli con parametri 14B e 15B ma comodamente davanti ai modelli comparabili 8B.

Tecniche di formazione

Le prestazioni del Falcon H1R 7B non sono solo architettoniche; deriva da un rigoroso percorso di formazione in due fasi progettato per massimizzare la densità del ragionamento senza gonfiare il conteggio dei parametri, secondo La relazione tecnica del TII sul modello.

Fase 1: Regolazione effective supervisionata con avviamento a freddo (SFT). Il modello è stato sottoposto a SFT “cold-start” su un set di dati curato dominato dalla matematica (56,8% dei token) e dal codice (29,8%), con lunghezze di risposta che arrivano fino a 48.000 token.

-

Ponderazione in base alla difficoltà: TII ha rifiutato la pratica normal di trattare tutti i dati allo stesso modo. Invece, hanno applicato uno schema di ponderazione in cui i problemi “difficili” venivano ponderati da 1,25x a 1,75x, mentre i problemi facili venivano ridotti o rimossi completamente per evitare un eccessivo adattamento a compiti banali.

-

Coerenza per insegnante singolo: Gli studi sull’ablazione hanno rivelato che mescolare tracce di ragionamento provenienti da più modelli di “insegnante” in realtà peggiorava le prestazioni a causa di stili di ragionamento contrastanti. Di conseguenza, TII ha optato per un approccio con un unico insegnante per mantenere una logica interna coerente.

-

Normalizzazione dei token bilanciati: Per gestire l’enorme varianza nella lunghezza delle sequenze (istruzioni brevi rispetto a catene di ragionamento massicce), il workforce ha introdotto una strategia di normalizzazione bilanciata dei token dati paralleli. Questa tecnica equalizza il contributo del gradiente di ciascun token tra le GPU, impedendo ai ranghi con sequenze più brevi di destabilizzare la perdita, una modifica che ha prodotto un aumento costante della precisione del 4-10% durante l’addestramento.

Fase 2: Apprendimento per rinforzo tramite l’ottimizzazione delle politiche relative di gruppo (GRPO). Dopo la SFT, il modello è stato perfezionato utilizzando GRPO, un algoritmo di apprendimento per rinforzo che premia i risultati corretti senza la necessità di un modello di valore separato.

-

Lo spostamento “No-KL”: In deviazione dall’RLHF normal, TII ha rimosso completamente la penalità di divergenza KL (beta = 0). Ciò ha permesso al modello di discostarsi significativamente dalla sua politica SFT di base, incoraggiando l’esplorazione aggressiva di nuovi percorsi di ragionamento.

-

Curriculum di sola matematica: Sorprendentemente, il TII ha scoperto che la formazione esclusivamente su problemi di matematica durante la fase RL ha prodotto una migliore generalizzazione in tutti i domini, inclusi codice e scienza, rispetto alle strategie miste. Le ablazioni hanno dimostrato che l’addestramento “solo codice” ha migliorato i punteggi di codifica ma ha danneggiato il ragionamento generale, mentre l’RL incentrato sulla matematica ha aumentato le prestazioni a livello globale.

TII ha ottimizzato il modello specificatamente per il Take a look at-Time Scaling (TTS), una tecnica in cui un modello genera più percorsi di ragionamento in parallelo per trovare la soluzione migliore.

Il modello utilizza Deep Suppose with Confidence (DeepConf), che sfrutta i punteggi di confidenza interni del modello per eliminare dinamicamente le tracce di ragionamento di bassa qualità.

-

Potatura adattiva: Durante la generazione, il sistema avvia una fase di “riscaldamento” con 16 tracce per stabilire una linea di base di confidenza. Quindi filtra in modo aggressivo le tracce successive, terminando qualsiasi catena che cade al di sotto del 10° percentile della confidenza di base.

-

Guadagni di efficienza: Questo metodo crea una nuova frontiera di Pareto per la distribuzione. Nei take a look at benchmark, Falcon H1R 7B ha raggiunto una precisione del 96,7% su AIME 25 riducendo l’utilizzo dei token del 38% rispetto alla linea di base DeepSeek-R1-0528-Qwen3-8B.

Licenza: aperta per uso commerciale, ma con vincoli

TII ha rilasciato Falcon H1R 7B con l’usanza Licenza Falcon LLM 1.0 basato su Apache 2.0 — ma con notevoli modifiche — principalmente tra queste: non intentare causa contro TII e anche dargli sempre credito.

Per gli sviluppatori e le startup, la licenza è ampiamente permissiva:

-

Esente da diritti d’autore: Gli utenti possono eseguire, modificare e distribuire il modello commercialmente senza pagare TII.

-

Attribuzione: Qualsiasi lavoro derivato (comprese le ottimizzazioni) deve indicare in modo visibile: “[Name of work] è costruito utilizzando la tecnologia Falcon LLM del Know-how Innovation Institute”.

Tuttavia, a differenza di una licenza Open Supply Initiative (OSI), la licenza Falcon embody una rigorosa politica di utilizzo accettabile (AUP).

La licenza termina automaticamente se il modello viene utilizzato per creare un’opera in conflitto con l’AUP o se l’utente avvia una controversia sui brevetti contro TII.

Nello specifico, l’AUP vieta l’utilizzo del Falcon H1R 7B o dei suoi derivati per:

-

Violazione delle leggi: qualsiasi utilizzo che violi le leggi o i regolamenti nazionali, federali, statali, locali o internazionali applicabili.

-

Danno a minori o esseri viventi: sfruttamento, danneggiamento o tentativo di sfruttare o danneggiare minori o qualsiasi essere vivente.

-

Disinformazione: generazione o diffusione di informazioni verificabilmente false con lo scopo di danneggiare gli altri.

-

Molestie: diffamare, denigrare o molestare in altro modo gli altri.

L’onda ibrida: Nvidia, IBM, AI21 e Mistral

TII non è il solo a scommettere su questo futuro ibrido; il settore si sta muovendo sempre più verso architetture che fondono i punti di forza degli SSM e dei Transformer.

-

Nvidia ha recentemente debuttato il Famiglia Nemotron 3 il 15 dicembre 2025, che utilizza una miscela ibrida di esperti (MoE) e il design Mamba-Transformer per promuovere un’intelligenza artificiale efficiente.

-

IBM ha lanciato il suo Famiglia Granito 4.0 il 2 ottobre 2025, utilizzando un’architettura ibrida Mamba-Transformer per ridurre i requisiti di memoria di oltre il 70% mantenendo prestazioni elevate rispetto ai benchmark aziendali.

-

AI21 ha perseguito questa strada con i suoi modelli Jamba (Joint Consideration e Mamba), rilasciando il Famiglia Jamba 1.5 il 22 agosto 2024, per potenziare le capacità di intelligenza artificiale degli agenti attraverso un approccio ibrido SSM-Transformer.

-

Maestrale è entrato presto nello spazio con Mamba Codestrale il 16 luglio 2024, un modello specificamente ottimizzato per una generazione di codice più rapida e più lunga.

Falcon H1R 7B rappresenta l’ultima evoluzione di questa tendenza, mirando specificamente a compiti di ragionamento densi in un fattore di forma compatto.