Addestrare modelli di intelligenza artificiale customary contro un gruppo diversificato di avversari, anziché costruire complesse regole di coordinamento codificate, è sufficiente per produrre sistemi multi-agente cooperativi che si adattano l’uno all’altro al volo. Questa è la scoperta del staff Paradigms of Intelligence di Google, che sostiene che l’approccio offre un progetto scalabile e computazionalmente efficiente per distribuzioni multi-agente aziendali senza richiedere impalcature specializzate.

La tecnica funziona addestrando un agente LLM tramite l’apprendimento di rinforzo decentralizzato contro un gruppo misto di avversari: alcuni apprendono attivamente, altri statici e basati su regole. Invece di regole codificate, l’agente utilizza l’apprendimento contestuale per leggere ogni interazione e adattare il proprio comportamento in tempo reale.

Perché i sistemi multi-agente continuano a combattersi tra loro

Il panorama dell’intelligenza artificiale si sta rapidamente spostando da sistemi isolati verso una flotta di agenti che devono negoziare, collaborare e operare simultaneamente in spazi condivisi. Nei sistemi multi-agente, il successo di un’attività dipende dalle interazioni e dai comportamenti di più entità anziché da un singolo agente.

L’attrito centrale in questi sistemi multi-agente è che le loro interazioni spesso coinvolgono obiettivi concorrenti. Poiché questi agenti autonomi sono progettati per massimizzare i propri parametri specifici, garantire che non si indeboliscano attivamente a vicenda in questi scenari con motivazioni miste è incredibilmente difficile.

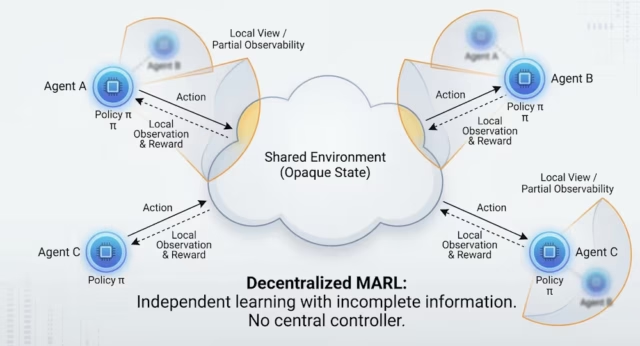

L’apprendimento per rinforzo multi-agente (MARL) cerca di affrontare questo problema addestrando più agenti IA che operano, interagiscono e apprendono nello stesso ambiente condiviso allo stesso tempo. Tuttavia, nelle architetture aziendali del mondo reale, un unico sistema centralizzato raramente ha visibilità o controlla ogni parte in movimento. Gli sviluppatori devono fare affidamento su MARL decentralizzato, in cui i singoli agenti devono capire come interagire con gli altri avendo accesso solo ai propri dati e osservazioni locali limitati.

Uno dei problemi principali del MARL decentralizzato è che gli agenti spesso rimangono bloccati in stati non ottimali mentre cercano di massimizzare le proprie ricompense specifiche. I ricercatori la chiamano “defezione reciproca”, sulla base del Il dilemma del prigioniero puzzle utilizzato nella teoria dei giochi. Advert esempio, pensa a due algoritmi automatizzati di determinazione dei prezzi impegnati in una corsa distruttiva verso il basso. Poiché ogni agente ottimizza rigorosamente per la propria ricompensa egoistica, arriva a una situazione di stallo in cui perde l’impresa nel suo insieme.

Un altro problema è che le strutture formative tradizionali sono progettate per ambienti stazionari, il che significa che le regole del gioco e il comportamento dell’ambiente sono relativamente fissi. In un sistema multi-agente, dal punto di vista di ogni singolo agente, l’ambiente è fondamentalmente imprevedibile e in costante cambiamento perché gli altri agenti stanno simultaneamente imparando e adattando le proprie politiche.

Sebbene gli sviluppatori aziendali attualmente si affidino a framework che utilizzano macchine a stati rigidi, questi metodi spesso incontrano un muro di scalabilità nelle implementazioni complesse.

“Il limite principale dell’orchestrazione hardcoded è la sua mancanza di flessibilità”, ha detto a VentureBeat Alexander Meulemans, coautore dell’articolo e ricercatore senior del staff Paradigms of Intelligence di Google. “Sebbene le macchine a stati rigidi funzionino adeguatamente in domini ristretti, possono non riuscire a scalare man mano che la portata e la complessità delle implementazioni degli agenti si ampliano. Il nostro approccio contestuale integra questi quadri esistenti promuovendo comportamenti sociali adattivi che sono profondamente radicati durante la fase post-formazione.”

Cosa significa questo per gli sviluppatori che utilizzano LangGraph, CrewAI o AutoGen

Framework come LangGraph richiedono agli sviluppatori di definire esplicitamente agenti, transizioni di stato e logica di routing come un grafico. LangChain descrive questo approccio come equivalente a una macchina a statidove i nodi agente e le loro connessioni rappresentano stati e matrici di transizione. L’approccio di Google inverte questo modello: invece di codificare come gli agenti dovrebbero coordinarsi, produce un comportamento cooperativo attraverso la formazione, lasciando agli agenti il compito di dedurre le regole di coordinamento dal contesto.

I ricercatori dimostrano che gli sviluppatori possono realizzare sistemi multi-agente avanzati e cooperativi utilizzando esattamente le stesse tecniche customary di modellazione di sequenze e apprendimento per rinforzo che già alimentano i modelli di base odierni.

Il staff ha convalidato il concetto utilizzando un nuovo metodo chiamato Predictive Coverage Enchancment (PPI), sebbene Meulemans osservi che il principio di base è indipendente dal modello.

“Invece di formare un piccolo gruppo di agenti con ruoli fissi, i staff dovrebbero implementare una routine di formazione ‘combined pool'”, ha affermato Meulemans. “Gli sviluppatori possono riprodurre queste dinamiche utilizzando algoritmi di apprendimento per rinforzo customary e pronti all’uso (come GRPO).”

Esponendo gli agenti all’interazione con diversi co-attori (advert esempio, variando i suggerimenti del sistema, i parametri ottimizzati o le politiche sottostanti) i staff creano un solido ambiente di apprendimento. Ciò produce strategie resilienti quando si interagisce con nuovi accomplice e garantisce che l’apprendimento multi-agente porti verso comportamenti cooperativi stabili e a lungo termine.

Come i ricercatori hanno dimostrato che funziona

Per costruire agenti in grado di dedurre con successo la strategia di un co-giocatore, i ricercatori hanno creato una configurazione di addestramento decentralizzata in cui l’intelligenza artificiale si confronta con un gruppo misto di avversari altamente diversificato composto da modelli di apprendimento attivo e programmi statici basati su regole. Questa diversità forzata richiede che l’agente capisca dinamicamente con chi sta interagendo e adatti il suo comportamento al volo, interamente dal contesto dell’interazione.

Per gli sviluppatori aziendali, la frase “apprendimento in contesto” spesso suscita preoccupazioni riguardo al gonfiamento delle finestre di contesto, ai costi delle API e alla latenza, soprattutto quando le finestre sono già piene di dati RAG (retrieval-augmented technology) e immediate di sistema. Tuttavia, Meulemans chiarisce che questa tecnica si concentra sull’efficienza piuttosto che sul conteggio dei token. “Il nostro metodo si concentra sull’ottimizzazione del modo in cui gli agenti utilizzano il contesto disponibile durante la fase post-formazione, piuttosto che richiedere rigorosamente finestre di contesto più ampie”, ha affermato. Addestrando gli agenti advert analizzare la cronologia delle loro interazioni per dedurre strategie, utilizzano il contesto assegnato in modo più adattivo senza richiedere finestre di contesto più lunghe rispetto alle applicazioni esistenti.

Utilizzando il dilemma del prigioniero iterato (IPD) come punto di riferimento, i ricercatori hanno ottenuto una cooperazione solida e stabile senza alcuna delle tradizionali stampelle. Non ci sono separazioni artificiali tra meta e studenti interiori, e non c’è bisogno di codificare ipotesi su come funziona l’algoritmo dell’avversario. Poiché l’agente si adatta in tempo reale e allo stesso tempo aggiorna i pesi del suo modello di base principale nel corso del tempo in molte interazioni, occupa effettivamente entrambi i ruoli contemporaneamente. In effetti, gli agenti hanno ottenuto risultati migliori quando non hanno ricevuto informazioni sui loro avversari e sono stati costretti advert adattarsi al loro comportamento attraverso tentativi ed errori.

Il ruolo dello sviluppatore passa da scrittore di regole advert architetto

I ricercatori affermano che il loro lavoro colma il divario tra l’apprendimento per rinforzo multi-agente e i paradigmi di formazione dei moderni modelli di base. “Poiché i modelli di base esibiscono naturalmente un apprendimento in contesto e sono addestrati su diversi compiti e comportamenti, i nostri risultati suggeriscono un percorso scalabile e computazionalmente efficiente per l’emergere di comportamenti sociali cooperativi utilizzando tecniche di apprendimento decentralizzato customary”, scrivono.

Poiché fare affidamento sull’adattamento comportamentale al contesto diventa lo customary rispetto a regole rigide codificate, l’elemento umano dell’ingegneria dell’IA cambierà radicalmente. “Il ruolo dello sviluppatore di applicazioni IA può evolversi dalla progettazione e gestione di regole di interazione individuali alla progettazione e fornitura di una supervisione architettonica di alto livello per gli ambienti di formazione”, ha affermato Meulemans. Questa transizione consente agli sviluppatori di passare dalla scrittura di regole ristrette all’assunzione di un ruolo strategico, definendo parametri generali che garantiscono che gli agenti imparino a essere utili, sicuri e collaborativi in qualsiasi situazione.