Mentre la rottura di Washington con Anthropic ha messo in luce la completa mancanza di regole coerenti che governino l’intelligenza artificiale, una coalizione bipartisan di pensatori ha messo insieme qualcosa che il governo ha finora rifiutato di produrre: un quadro per come dovrebbe effettivamente essere lo sviluppo responsabile dell’intelligenza artificiale.

IL Dichiarazione pro-umanità è stato finalizzato prima dello stallo Pentagono-Anthropic della scorsa settimana, ma la collisione dei due eventi non è sfuggita a nessuno dei soggetti coinvolti.

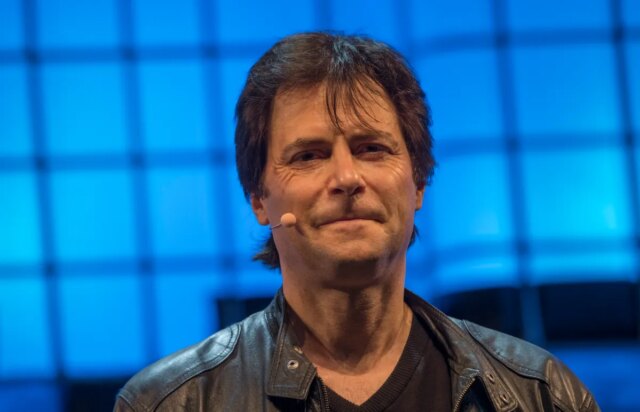

“C’è qualcosa di veramente straordinario che è successo in America proprio negli ultimi quattro mesi”, ha detto Max Tegmark, il fisico del MIT e ricercatore sull’intelligenza artificiale che ha contribuito a organizzare l’iniziativa, nella conversazione con questo editore. “Sondaggio all’improvviso [is showing] che il 95% di tutti gli americani si oppone a una corsa non regolamentata alla superintelligenza”.

Il documento appena pubblicato, firmato da centinaia di esperti, ex funzionari e personaggi pubblici, si apre con l’osservazione concreta che l’umanità è a un bivio. Un percorso, che la dichiarazione chiama “la corsa alla sostituzione”, porta a soppiantare gli esseri umani prima come lavoratori, poi come decisori, mentre il potere viene assegnato a istituzioni irresponsabili e alle loro macchine. L’altro porta all’intelligenza artificiale che espande enormemente il potenziale umano.

Quest’ultimo situation dipende da cinque pilastri chiave: mantenere gli esseri umani al comando, evitare la concentrazione del potere, proteggere l’esperienza umana, preservare la libertà individuale e ritenere legalmente responsabili le società di intelligenza artificiale. Tra le sue disposizioni più energiche c’è il divieto assoluto dello sviluppo della superintelligenza fino a quando non ci sarà un consenso scientifico che possa essere fatto in modo sicuro e con un autentico consenso democratico; interruttori di spegnimento obbligatori su sistemi potenti; e il divieto di architetture capaci di autoreplicazione, auto-miglioramento autonomo o resistenza allo spegnimento.

La pubblicazione della dichiarazione coincide con un periodo che rende molto più facile apprezzarne l’urgenza. L’ultimo venerdì di febbraio, il segretario alla Difesa Pete Hegseth ha designato Anthropic – la cui intelligenza artificiale già funziona su piattaforme militari classificate – un “rischio nella catena di fornitura” dopo che la società si è rifiutata di concedere al Pentagono l’uso illimitato della sua tecnologia, un’etichetta normalmente riservata alle aziende con legami con la Cina. Ore dopo, OpenAI ha concluso un accordo con il Dipartimento della Difesa, un accordo che secondo gli esperti legali sarà difficile far rispettare in modo significativo. Ciò che tutto ciò mette in luce è quanto sia diventata costosa l’inazione del Congresso sull’intelligenza artificiale.

Come Dean Ball, membro senior della Basis for American Innovation, ha detto al New York Times in seguito, “Questa non è solo una disputa su un contratto. Questa è la prima conversazione che abbiamo avuto come Paese sul controllo sui sistemi di intelligenza artificiale”.

Evento Techcrunch

San Francisco, California

|

13-15 ottobre 2026

Tegmark ha cercato un’analogia che la maggior parte delle persone può capire quando abbiamo parlato. “Non devi mai preoccuparti che qualche azienda farmaceutica rilasci qualche altro farmaco che causa danni enormi prima che le persone abbiano capito come renderlo sicuro”, ha detto, “perché la FDA non permetterà loro di rilasciare nulla finché non sarà abbastanza sicuro.”

Le guerre per il territorio di Washington raramente generano il tipo di pressione pubblica story da modificare le leggi. Tegmark vede invece la sicurezza dei bambini come il punto di pressione che più probabilmente risolverà l’attuale deadlock. In effetti, la dichiarazione richiede check pre-implementazione obbligatori dei prodotti di intelligenza artificiale – in particolare chatbot e app complementari rivolte agli utenti più giovani – che coprano rischi tra cui l’aumento dell’concept suicidaria, l’esacerbazione delle condizioni di salute mentale e la manipolazione emotiva.

“Se un vecchio inquietante manda messaggi a un bambino di 11 anni che finge di essere una ragazzina e cerca di convincerlo a suicidarsi, il ragazzo può andare in prigione per questo”, ha detto Tegmark. “Abbiamo già delle leggi. È illegale. Allora perché è diverso se lo fa una macchina?”

Egli ritiene che una volta stabilito il principio dei check pre-release per i prodotti per bambini, il campo di applicazione si amplierà quasi inevitabilmente. “Le persone arriveranno e diranno: aggiungiamo qualche altro requisito. Forse dovremmo anche testare che questo non possa aiutare i terroristi a creare armi biologiche. Forse dovremmo testare per assicurarci che la superintelligenza non abbia la capacità di rovesciare il governo degli Stati Uniti.”

Non è una cosa da poco che l’ex consigliere di Trump Steve Bannon e Susan Rice, consigliere per la sicurezza nazionale del presidente Obama, abbiano firmato lo stesso documento – insieme all’ex presidente dei Joint Chiefs Mike Mullen e ai chief religiosi progressisti.

“Quello su cui sono d’accordo, ovviamente, è che sono tutti umani”, cube Tegmark. “Se si tratta di decidere se vogliamo un futuro per gli esseri umani o un futuro per le macchine, ovviamente saranno dalla stessa parte.”