La maggior parte delle persone non si rende conto della profonda minaccia che presto rappresenterà l’intelligenza artificiale agenzia umana. Un ritornello comune è questo “L’intelligenza artificiale è solo uno strumento” e come ogni strumento, i suoi benefici e i suoi pericoli dipendono da come le persone lo utilizzano. Questo è il pensiero della vecchia scuola. L’intelligenza artificiale sta passando da strumenti che utilizziamo A protesi che indossiamo. Questo creerà nuove minacce significative semplicemente non siamo preparati per.

No, non sto parlando di inquietanti impianti cerebrali. Queste protesi basate sull’intelligenza artificiale saranno i prodotti tradizionali che acquistiamo da Amazon o dall’Apple Retailer e commercializzati con nomi amichevoli come “assistenti”, “allenatori”, “copiloti” e “tutor”. Forniranno un valore reale nella nostra vita, al punto che ci sentiremo svantaggiati se gli altri li indossano e noi no. Ciò creerà una rapida pressione per l’adozione di massa.

I dispositivi protesici a cui mi riferisco sono “Dispositivi indossabili basati sull’intelligenza artificiale“come occhiali intelligenti, pendenti, spille e auricolari. La tua IA indossabile vedrà ciò che vedi e sentirà ciò che senti, il tutto monitorando dove sei, cosa stai facendo, con chi sei e cosa stai cercando di ottenere. Quindi, senza che tu abbia bisogno di dire una parola, questi aiuti mentali ti sussurrare consigli nelle orecchie o guida flash davanti ai tuoi occhi.

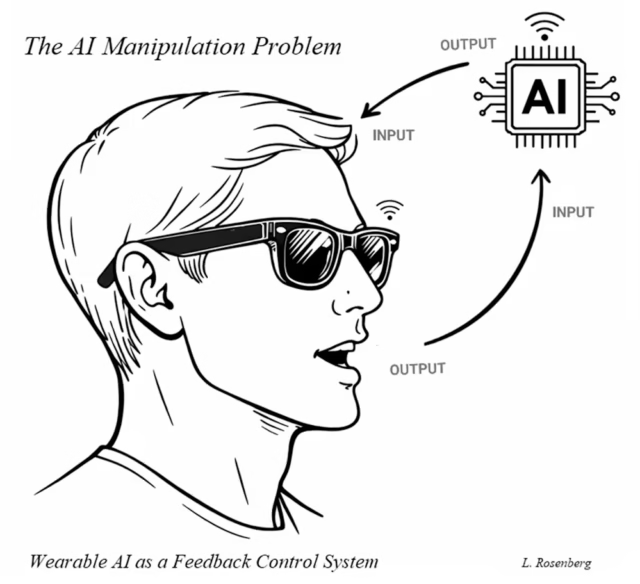

La differenza tra uno strumento e una protesi può sembrare sottile, ma… implicazioni per l’agire umano sono profondi. Ciò si comprende meglio attraverso una semplice analisi di enter e output. Uno strumento riceve enter umani e genera output amplificati. Uno strumento può renderci più forti, più veloci o permetterci di volare. Una protesi mentale, d’altro canto, forma un circuito di suggestions attorno all’essere umano, accettando enter dall’utente (tracciando le sue azioni e coinvolgendolo in una conversazione) e generando output che può influenzare immediatamente il pensiero dell’utente.

Questo ciclo di suggestions cambia tutto. Questo perché i dispositivi di intelligenza artificiale indossati sul corpo saranno in grado di monitorare i nostri comportamenti e le nostre emozioni e potrebbero utilizzare questi dati parlaci credere a cose false, acquistare cose di cui non abbiamo bisogno o adottare punti di vista che altrimenti realizzeremmo non sono nel nostro migliore interesse. Questo si chiama il problema della manipolazione dell’intelligenza artificialee non siamo pronti per i rischi. Si tratta di una questione urgente perché le grandi aziende tecnologiche stanno correndo per portare questi prodotti sul mercato.

Perché i cicli di suggestions sono così pericolosi?

Nel mondo di oggi, tutti i dispositivi informatici vengono utilizzati per esercitare un’influenza mirata per conto degli sponsor paganti. I prodotti AI indossabili probabilmente continueranno questa tendenza. Il problema è che a questi dispositivi potrebbe essere facilmente assegnato un “influenzare l’obiettivo” e hanno il compito di ottimizzare il loro impatto sull’utente, adattando le loro tattiche di conversazione per superare qualsiasi resistenza che rilevano. Questo trasforma il concetto di influenza mirata dai pallettoni dei social media ai missili a ricerca di calore che superano abilmente le tue difese. Eppure, i politici non apprezzano questo rischio.

Sfortunatamente, la maggior parte dei regolatori vede ancora il pericolo dell’intelligenza artificiale in termini di capacità di generare rapidamente forme di influenza tradizionali (deepfakes, pretend information, propaganda). Naturalmente, queste sono minacce significative, ma non sono così pericolose come quelle influenza interattiva e adattiva che potrebbe presto essere ampiamente implementato attraverso agenti conversazionali, soprattutto quando questi agenti di intelligenza artificiale viaggiano con noi attraverso le nostre vite all’interno di dispositivi indossabili.

Questo arriverà presto

Meta, Google e Apple stanno facendo a gara per lanciare prodotti AI indossabili il più rapidamente possibile. Per proteggere il pubblico, i politici devono abbandonare il loro approccio all’uso degli strumenti quando regolano i dispositivi di intelligenza artificiale. Questo è difficile perché la metafora dell’uso dello strumento risale a 35 anni fa, quando Steve Jobs descrisse in modo colorito il PC come un “bicicletta della mente.” Una bicicletta è uno strumento potente che mantiene il ciclista saldamente in controllo. L’intelligenza artificiale indossabile capovolgerà questa metafora, facendoci chiedere chi sta guidando la bicicletta: l’umano, gli agenti dell’intelligenza artificiale che sussurrano nelle orecchie dell’umano o le società che hanno schierato gli agenti? Credo che sarà un pericoloso combine di tutti e tre.

Inoltre, gli utenti probabilmente si fideranno di Voci di intelligenza artificiale nelle loro teste più di quanto dovrebbero. Questo perché questi agenti di intelligenza artificiale ci forniranno consigli e informazioni utili durante tutta la nostra vita quotidiana: educandoci, ricordandoci, istruendoci, informandoci. Il problema è che potremmo non essere in grado di distinguere quando l’agente AI ha spostato il suo obiettivo dall’aiutarci all’influenzarci. Per apprezzare la differenza, potresti guardare il pluripremiato cortometraggio Privacy perduta (2023) sui pericoli dei dispositivi indossabili basati sull’intelligenza artificiale. Ciò è particolarmente vero quando i dispositivi includono funzionalità invasive come il riconoscimento facciale (che Secondo quanto riferito, Meta sta aggiungendo agli occhiali).

Cosa possiamo fare per proteggere il pubblico?

Innanzitutto, i politici devono rendersi conto che l’intelligenza artificiale conversazionale consente una forma di media completamente nuova che sia interattivo, adattivo, individualizzato e sempre più consapevole del contesto. Questa nuova forma di media funzionerà come “influenza attiva”, perché può adattare le sue tattiche in tempo reale per superare la resistenza degli utenti. Se implementati in dispositivi indossabili, questi sistemi di intelligenza artificiale potrebbero essere progettati per manipolare le nostre azioni, influenzare le nostre opinioni e influenzare le nostre convinzioni – e farlo attraverso dialogo apparentemente casuale. Quel che è peggio, questi agenti impareranno col tempo quali tattiche di conversazione funzionano meglio su ciascuno di noi a livello personale.

Il fatto è che agenti conversazionali non dovrebbe essere consentito loro di formare cicli di controllo intorno agli utenti. Se questo non viene regolamentato, l’intelligenza artificiale sarà in grado di influenzarci con una persuasività sovrumana. Inoltre, gli agenti IA dovrebbero esserlo tenuti ad informare gli utenti ogni volta che passano all’espressione di contenuti promozionali per conto di terzi. Senza tali protezioni, gli agenti di intelligenza artificiale diventeranno probabilmente così persuasivi da far sembrare bizzarre le odierne tecniche di influenza mirata.

Louis Rosenberg è un pioniere della realtà aumentata e un ricercatore di intelligenza artificiale di lunga knowledge. Ha conseguito il dottorato di ricerca a Stanford, è stato professore alla California State College e autore di numerosi libri sui pericoli dell’intelligenza artificiale, tra cui Arrival Thoughts e Our Subsequent Actuality.

Benvenuto nella comunità VentureBeat!

Il nostro programma di visitor posting è il luogo in cui gli esperti tecnici condividono approfondimenti e forniscono approfondimenti neutrali e non conferiti su intelligenza artificiale, infrastruttura dati, sicurezza informatica e altre tecnologie all’avanguardia che plasmano il futuro dell’impresa.

Per saperne di più dal nostro programma di publish per gli ospiti e dai un’occhiata al nostro linee guida se sei interessato a contribuire con un tuo articolo!