Democratici al Congresso avanti Questa settimana il comitato economico congiunto ha pubblicato un rapporto che individua oltre 20,9 miliardi di dollari di perdite per i consumatori derivanti dal furto di identità derivante da quattro gravi violazioni delle società di intermediazione di dati. La senatrice americana Maggie Hassan ha avviato l’indagine in agosto dopo un’indagine condotta da Il markup E CalMatterscopubblicato da WIRED, ha scoperto che alcuni dealer di dati nascondevano strumenti di opt-out da Google e da altri motori di ricerca.

Il recente rilascio da parte del Dipartimento di Giustizia degli Stati Uniti di 3 milioni di documenti relativi al condannato per reati sessuali Jeffrey Epstein includeva mandati di comparizione del gran giurì a Google che fanno luce su come gli investigatori federali interagiscono con le aziende tecnologiche e su come rispondono alle richieste di informazioni del governo.

Il cartello della droga messicano CJNG potrebbe sopravvivere all’uccisione del suo chief di lunga knowledge Nemesio “El Mencho” Oseguera Cervantes, in parte grazie al suo uso prolifico di tecnologie come droni, social media e intelligenza artificiale. Nel frattempo, la Marina messicana ha annunciato giovedì di aver sequestrato una nave semi-sommergibile che trasportava quasi 4 tonnellate di cocaina come parte di una recente iniziativa per scoraggiare il traffico di droga nell’Oceano Pacifico. L’iniziativa arriva mentre gli Stati Uniti hanno lanciato la propria presunta campagna contro il traffico marittimo attraverso una serie di attacchi mortali alle imbarcazioni nei Caraibi.

Nel frattempo, mentre gli agenti assistenti di intelligenza artificiale come OpenClaw esplodono in popolarità e seminano il caos sul net, un nuovo progetto open supply chiamato IronCurtain sta utilizzando un design unico per proteggere e limitare l’intelligenza artificiale degli agenti prima che possa diventare canaglia.

E c’è di più. Ogni settimana raccogliamo le notizie sulla sicurezza e sulla privateness che non abbiamo trattato in modo approfondito. Clicca sui titoli per leggere le storie full. E stai al sicuro là fuori.

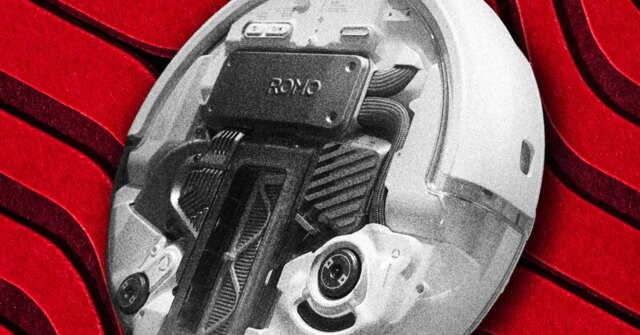

Lasciare un robotic autonomo abilitato a Web libero nella tua casa dovrebbe dare a chiunque un momento di pausa. Quando quel robotic è un aspirapolvere ambulante dotato di telecamera e microfono che potrebbe essere dirottato da qualsiasi parte del mondo con nient’altro che il suo numero di serie, diventa una vera e propria storia dell’orrore per la privateness.

Uno di questi proprietari di robovac, Sammy Azdoufal, ha scoperto quell’assurda vulnerabilità di sicurezza mentre tentava un esperimento di pilotaggio del suo robotic aspirapolvere DJI Romo con un controller PS5. Scoprì che poteva invece controllare 6.700 robotic in 24 paesi in tutto il mondo, con pieno accesso alle planimetrie generate delle case dei loro proprietari e ai loro feed video e audio. Quando The Verge ha contattato Azdoufal, è stato in grado di accedere immediatamente a un Romo di proprietà di un membro dello employees del punto vendita di notizie tecnologiche semplicemente conoscendone il numero di serie di 14 cifre. DJI ha ora risolto la vulnerabilità in risposta advert Azdoufal che essenzialmente ha twittato in tempo reale le sue scoperte. Ma la storia solleva comunque seri interrogativi sulla sicurezza di altri gadget dell’web delle cose abilitati per audio o video, per non parlare di quelli in grado di vagare liberamente per casa.

Mentre il Dipartimento della Patria ha ricevuto enormi poteri sotto l’amministrazione Trump nella sua missione di deportare milioni di immigrati, l’organizzazione all’interno del DHS che funge da principale difensore informatico degli Stati Uniti, la Cybersecurity and Infrastructure Safety Company, è stata trascurata. Ora il suo direttore advert interim, Madhu Gottumukkala, è stato sostituito mentre la CISA cerca di trovare una nuova posizione.

Anche prima di quella notizia, CyberScoop questa settimana riportato sulla crisi che ha afflitto l’agenzia per tutto il primo anno dall’insediamento di Trump: un terzo del personale è stato licenziato e interi reparti dell’agenzia sono stati chiusi. Le nomine per un direttore permanente sono state bloccate al Congresso. Le sue capacità si sono indebolite e le organizzazioni che si erano rivolte alla CISA per assistenza e partnership hanno guardato altrove. Gottumukkala ha subito i suoi scandali più personali, come l’espulsione del personale di sicurezza dopo aver fallito un check del poligrafo e la condivisione di contratti sensibili su ChatGPT. Ora Nick Andersen, che è stato direttore esecutivo della sicurezza informatica della CISA, sostituirà Gottumukkala nell’agenzia assediata.

Un ricercatore del King’s Faculty di Londra ha messo uno contro l’altro tre popolari modelli linguistici di grandi dimensioni in scenari simulati di giochi di guerra e ha scoperto che, il 95% delle volte, almeno uno dei modelli ha scelto di schierare armi nucleari tattiche. Anche il ricercatore trovatoquando un modello IA ha schierato un’arma nucleare tattica, il suo avversario IA ha ridotto l’escalation solo un quarto delle volte. Nessuna delle aziende dietro i tre modelli – OpenAI, Google e Anthropic – ha risposto alla richiesta di commento di New Scientist.

Il ruolo dell’intelligenza artificiale nella lotta alla guerra è balzato sotto i riflettori questa settimana. Anthropic e il Dipartimento della Guerra sono coinvolti in una disputa contrattuale sulla possibilità di utilizzare i modelli di intelligenza artificiale di Anthropic per alimentare armi completamente autonome e sorveglianza domestica di massa. Dario Amodei, amministratore delegato di Anthropic, ha scritto in a dichiarazione che questi tipi di casi d’uso “possono minare, piuttosto che difendere, i valori democratici”. A sua volta, il presidente Donald Trump ha minacciato di vietare l’uso di prodotti antropici, compreso il chatbot Claude, all’interno del governo degli Stati Uniti. Nel frattempo, centinaia di dipendenti di Google e OpenAI hanno firmato un accordo lettera aperta chiedendo ai loro capi di “mettere da parte le loro differenze e restare uniti per continuare a rifiutare le attuali richieste del Dipartimento di Guerra per il permesso di utilizzare i nostri modelli per la sorveglianza di massa interna e per uccidere autonomamente persone senza supervisione umana”.

Una nuova app per telefoni Android chiamata Nearside Glasses consente agli utenti di cercare occhiali intelligenti nelle vicinanze, rivelando la presenza di gadget indossabili, che a volte sono indistinguibili dai normali occhiali e consentono a chi li indossa di registrare le persone a loro insaputa. L’app esegue la scansione delle firme Bluetooth univoche emesse dagli occhiali e invia agli utenti una notifica se rileva una fonte vicina.

Lo sviluppatore ha dichiarato a 404 Media di aver avuto l’ispirazione per creare l’app dopo aver letto di diversi incidenti che coinvolgevano gli occhiali intelligenti. Durante l’property, 404 Media ha riferito che un agente della dogana e della protezione delle frontiere lo aveva fatto indossato un paio durante un raid di immigrazione, e questo autunno l’outlet ha anche riferito che gli uomini usavano occhiali intelligenti lavoratori della sala massaggi cinematograficiapparentemente senza la loro conoscenza o il loro consenso. A febbraio, il New York Instances riportato che uno sviluppatore di occhiali intelligenti, Meta, aveva in programma di integrare il riconoscimento facciale nei suoi occhiali, suscitando nuove preoccupazioni tra gli esperti di privateness.