I negoziati tra il Pentagono e la società di intelligenza artificiale Anthropic si sono complicati gravemente venerdì quando il presidente Donald Trump ha annunciato su Reality Social che il governo avrebbe smesso di utilizzare la tecnologia dell’azienda. Il presidente ha ordinato al Pentagono di iniziare un’eliminazione graduale di sei mesi, accusando Anthropic di essere gestita da “lavori di sinistra”.

IL Verità Post sociale ha affermato che Anthropic voleva che il governo rispettasse i suoi termini di servizio.

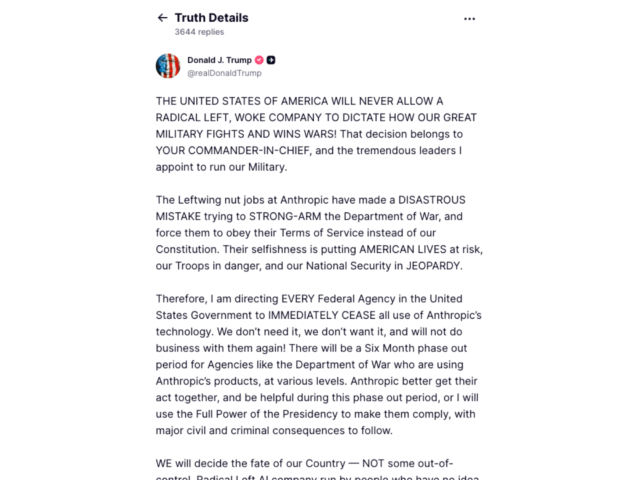

“Gli Stati Uniti d’America non permetteranno mai advert una sinistra radicale e sveglia di dettare come i nostri grandi militari combattono e vincono le guerre!”, ha scritto Trump. “Questa decisione appartiene al VOSTRO COMANDANTE IN CAPO e agli straordinari chief che nomino per dirigere le nostre forze armate. I pazzi di sinistra di Anthropic hanno commesso un ERRORE DISASTROSO cercando di FORZARE il Dipartimento della Guerra e costringerlo a obbedire ai loro Termini di servizio invece che alla nostra Costituzione. “

Credito: screenshot per gentile concessione di Reality Social

Il governo federale e Anthropic sono in disaccordo da settimane mentre cercano di raggiungere un accordo su come i militari possono utilizzare Claude, il modello di intelligenza artificiale di Anthropic. L’amministratore delegato di Anthropic, Dario Amodei, è stato fermo nel dire che non permetterà al Pentagono di utilizzare Claude per la sorveglianza di massa degli americani o per creare armi autonome, come i droni senza pilota.

Secondo quanto riferito, il governo ha accettato tali termini, secondo il New York Timesma il linguaggio giuridico del contratto offriva troppo margine di manovra per il conforto di Anthropic. Antropico è noto per aver adottato un approccio più cauto allo sviluppo dell’intelligenza artificiale, e i suoi fondatori hanno notoriamente lasciato OpenAI per problemi di sicurezza dell’intelligenza artificiale.

Giovedì Amodei ha spiegato la sua posizione in un post sul blog:

Velocità della luce mashable

“Anthropic è consapevole che è il Dipartimento della Guerra, e non le aziende non-public, a prendere le decisioni militari. Non abbiamo mai sollevato obiezioni a particolari operazioni militari né tentato di limitare l’uso della nostra tecnologia in modo advert hoc.

Tuttavia, in un numero ristretto di casi, riteniamo che l’intelligenza artificiale possa minare, anziché difendere, i valori democratici. Alcuni usi sono semplicemente al di fuori dei limiti di ciò che la tecnologia odierna può fare in modo sicuro e affidabile.”

È stata fissata la scadenza di venerdì sera per un accordo tra il Pentagono e Anthropic. Non è chiaro se l’annuncio di Trump di una graduale eliminazione equivarrà a più tempo per i negoziati o se il governo sta davvero andando avanti con il licenziamento di Anthropic dichiarandolo un rischio per la catena di approvvigionamento. Secondo il governo, il governo potrebbe anche cercare di costringere Anthropic advert accettare i suoi termini attraverso il Protection Manufacturing Act Volte. Il governo potrebbe anche scegliere un altro accomplice per l’intelligenza artificiale, come Grok di Elon Musk, ma i funzionari della CIA ritengono che il prodotto sia inferiore a quello di Anthropic, il Volte rapporti.

Dopo l’annuncio del presidente venerdì pomeriggio, il CEO di OpenAI Sam Altman è apparso sulla CNBC e ha espresso sostegno advert Anthropic. “Nonostante tutte le differenze che ho con Anthropic, mi fido soprattutto di loro come azienda e penso che abbiano davvero a cuore la sicurezza, e sono felice che abbiano supportato i nostri combattenti in guerra,” ha detto Altman, secondo una clip dell’apparizione pubblicata su X.

Questo Tweet non è al momento disponibile. Potrebbe essere in fase di caricamento o è stato rimosso.

Nel frattempo, decine di dipendenti di Google e OpenAI, entrambi concorrenti di Anthropic, hanno firmato lettere a sostegno delle posizioni di Amodei. E fuori dal quartier generale di Anthropic a San Francisco, parole di sostegno sono apparse scritte con il gesso sul marciapiede, secondo un submit su X.

Questo Tweet non è al momento disponibile. Potrebbe essere in fase di caricamento o è stato rimosso.

Questa settimana, Anthropic ha ammorbidito la sua politica di sicurezza, spesso vista come una delle più forte nella Silicon Valley – citando la riluttanza dei concorrenti a fare lo stesso e il disinteresse del governo federale nel dare priorità alla sicurezza.

“Il contesto politico si è spostato verso la priorità knowledge alla competitività dell’intelligenza artificiale e alla crescita economica, mentre le discussioni orientate alla sicurezza devono ancora guadagnare terreno a livello federale”, ha scritto la società. “Rimaniamo convinti che un impegno efficace del governo sulla sicurezza dell’IA sia necessario e realizzabile, e miriamo a continuare a portare avanti un dialogo fondato su show, interessi di sicurezza nazionale, competitività economica e fiducia pubblica. Ma questo si sta rivelando un progetto a lungo termine, non qualcosa che sta accadendo in modo organico man mano che l’intelligenza artificiale diventa più capace o supera determinate soglie.”

Divulgazione: Ziff Davis, la società madre di Mashable, nell’aprile 2025 ha intentato una causa contro OpenAI, sostenendo di aver violato i diritti d’autore di Ziff Davis nella formazione e nel funzionamento dei suoi sistemi di intelligenza artificiale.