Poiché i flussi di lavoro basati sull’intelligenza artificiale moltiplicano i costi e la latenza di lunghe catene di ragionamento, un crew dell’Università del Maryland, dei Lawrence Livermore Nationwide Labs, della Columbia College e di TogetherAI ha trovato un modo per ottenere guadagni di throughput 3 volte superiori direttamente nei pesi di un modello.

A differenza della decodifica speculativa, che richiede un modello di redazione separato, questo approccio non richiede infrastrutture aggiuntive, ma solo un singolo token speciale aggiunto all’architettura esistente del modello.

I limiti della previsione del prossimo token

La previsione del token successivo, ovvero la generazione di testo di un token per passaggio in avanti, crea un limite di throughput che diventa estremamente costoso quando i modelli devono produrre migliaia di token. Questo collo di bottiglia è particolarmente problematico nei modelli di ragionamento, che spesso generano migliaia di “catena di pensiero” token prima di produrre la risposta finale, portando a un’esperienza utente lenta e costosa.

La previsione multi-token (MTP) offre un paradigma di coaching alternativo che consente a un modello linguistico di produrre più token contemporaneamente in un unico passaggio in avanti. Advert esempio, il modello può essere addestrato a prevedere un blocco di token tutti in una volta anziché solo il token immediatamente successivo.

John Kirchenbauer, dottorando in informatica presso l’Università del Maryland e coautore dell’articolo, ha dichiarato a VentureBeat che mentre ci muoviamo verso flussi di lavoro basati su agenti, l’attenzione si sta spostando dal throughput complessivo alla velocità del singolo utente. “Oggi, con le tracce di pensiero ultra-lunghe che sono la norma e i circuiti esterni degli agenti che moltiplicano ulteriormente tali costi, la latenza sta diventando una dimensione dell’efficienza complessiva del servizio tanto importante quanto i token lordi al secondo per unità {hardware} (tps/GPU)”, ha affermato Kirchenbauer. Ha affermato che mentre la previsione normal del token successivo in batch è già ottimale per il throughput complessivo, il nuovo approccio “sforzarsi[s] per saturare la GPU con la sola question di un singolo utente per ridurre la latenza per quel singolo utente.”

Esistono altri metodi, ma presentano degli inconvenienti. “Vale la pena notare che la decodifica speculativa e i LLM di diffusione come alternativa focalizzata sull’efficienza alla previsione del prossimo token (NTP), sono entrambe tecniche di accelerazione focalizzate sulla latenza”, ha affermato Kirchenbauer. Ma la decodifica speculativa richiede l’implementazione e la gestione di un modello di “redazione” ausiliario, che impiega più calcolo assoluto per la stesura e la verifica. MTP, d’altro canto, “fa leva su un simile tipo di compromesso, è semplicemente più semplice da servire e scientificamente interessante di per sé”.

Gli attuali paradigmi MTP presentano tuttavia dei limiti. L’obiettivo normal per l’addestramento di un modello linguistico per MTP prevede il confronto delle sue previsioni con il testo di base di un set di dati. La trappola è che questa formazione normal insegna al modello a prevedere la probabilità di un token in una posizione specifica in modo indipendente, piuttosto che preoccuparsi della relazione congiunta tra una sequenza di token.

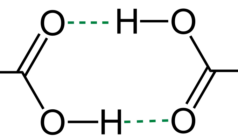

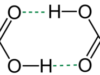

Se un modello tenta di prevedere più token contemporaneamente utilizzando questo metodo normal, si verificano due problemi principali. Il primo è la mancata corrispondenza grammaticale. Advert esempio, se un modello prevede due parole che seguono il prefisso “Il guardiano dello zoo ha nutrito il”, potrebbe campionare in modo indipendente e produrre una frase non corrispondente come “carne di panda” o “bambù di leone” invece di “bambù di panda” e “carne di leone”.

Il secondo problema è la ripetizione degenerata. Poiché il testo tipico è imprevedibile, un modello che tenta di prevedere un token 100 posizioni nel futuro rispetto a un set di dati normal prevederà semplicemente “the”, poiché è la parola più comune in inglese. Ciò si traduce nel modello che produce sciocchezze come “…il il il…” per posizioni nel lontano futuro.

Previsione multi-token tramite autodistillazione

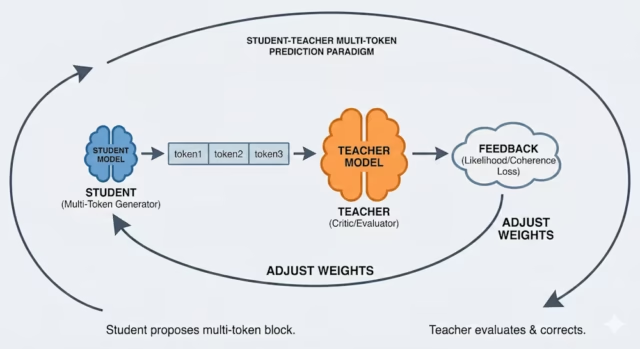

Per risolvere il problema della generazione di token multipli, i ricercatori propongono una nuova tecnica di formazione che utilizza uno schema studente-insegnante. Un modello studentesco, ovvero il modello che impara a prevedere più token, genera un blocco multi-token deterministico. Un modello dell’insegnante, che agisce come un forte modello linguistico di previsione del token successivo, valuta quel blocco. L’insegnante agisce come un critico, calcolando quanto sia probabile e coerente la sequenza proposta dallo studente. Se lo studente propone una frase non corrispondente come “bambù leone”, l’insegnante gli assegna una perdita elevata, insegnando allo studente a evitare quella costruzione.

Il paradigma si ispira all’apprendimento per rinforzo basato sulle politiche perché il modello dello studente non consiste semplicemente nel memorizzare un testo statico. Genera un rollout completo (sequenza di azioni nel gergo RL) istantaneamente in parallelo su un singolo passaggio in avanti e riceve una ricompensa in base a quanto l’insegnante ritiene che sia bravo. A differenza dei metodi statici supervisionati in cui le coppie di formazione sono fissate in anticipo, il suggestions qui è dinamico, generato dai risultati dello studente in tempo reale. L’insegnante forte verifica anche la coerenza dei token, il che impedisce al modello studentesco di apprendere risultati degenerati come parole ripetute.

Per gli sviluppatori, la bellezza di questo approccio risiede nella sua semplicità. “Non ci sono davvero modifiche all’architettura tranne l’aggiunta di un token speciale”, ha detto Kirchenbauer. Cooptando uno slot inutilizzato nella matrice di incorporamento esistente di un modello per agire come un

Per i crew di ingegneri, ciò significa che l’adattamento può essere applicato a modelli già in produzione senza ricostruire le condutture.

La generazione di più token contemporaneamente può comunque compromettere l’accuratezza della risposta al momento dell’inferenza. Per massimizzare la velocità di generazione senza sacrificare la qualità dell’output, gli autori introducono una strategia di decodifica adattiva chiamata ConfAdapt.

ConfAdapt valuta una soglia di confidenza, advert esempio il 90%, advert ogni passaggio. Il modello genera un blocco di token, ma conserva solo i token che soddisfano o superano questa soglia di confidenza elevata. Quando il testo in arrivo è altamente prevedibile o strutturale, la fiducia del modello è molto elevata. Accetterà e produrrà una grande quantità di token tutti in una volta, risparmiando tempo di calcolo significativo su token semplici. Quindi concentra i suoi costosi passaggi a token singolo su token più difficili che richiedono uno sforzo computazionale maggiore.

Mettere alla prova la previsione multi-token

Per vedere come funzionava nella pratica il paradigma di allenamento, i ricercatori hanno applicato il loro metodo a modelli popolari regolati con istruzioni a peso aperto. Hanno testato il potente modello per uso generale Llama-3.1-8B-Magpie e il più piccolo ed efficiente Qwen3-4B-Instruct-2507, che viene spesso scelto per implementazioni aziendali sensibili ai costi. Entrambi i modelli sono stati ottimizzati su MetaMathQA, un set di dati di problemi di matematica sintetici delle scuole elementari che fanno molto affidamento su tracce di ragionamento.

Gli esperimenti hanno rivelato un chiaro equilibrio tra velocità e precisione. Utilizzando la strategia ConfAdapt, il modello Llama-3.1-8B ha ottenuto una velocità 3 volte superiore con un calo di precisione inferiore al 3% sui benchmark matematici. Il modello Qwen3-4B ha raggiunto la stessa velocità 3x con un calo di precisione leggermente superiore del 7%. Impostazioni più aggressive potevano raggiungere accelerazioni 5x, sebbene comportassero penalità di precisione più elevate.

Il modo in cui ciò si traduce in attività del mondo reale dipende dalla prevedibilità. “Poiché l’approccio ConfAdapt adatta naturalmente l’accelerazione all’entropia intrinseca nel dominio, quando il modello ‘sa’ esattamente cosa verrà dopo può emetterlo in un unico passaggio”, ha osservato, portando a una massiccia accelerazione su compiti prevedibili, utilizzando più passaggi per risultati incerti.

Le accelerazioni sono state trasferite anche tra domini non inclusi nella fase di addestramento della previsione multi-token. Ciò includeva attività all’interno dello stesso dominio dei dati di addestramento, come matematica e ragionamento, nonché attività a tempo indeterminato come la scrittura creativa e il riepilogo.

Nonostante questo trasferimento di apprendimento, le imprese che implementano questi modelli per compiti specializzati non dovrebbero fare affidamento interamente su di esso. “La nostra raccomandazione sarebbe quella di mettere a punto/adattare il modello per MTP utilizzando campioni provenienti dal settore industriale speciale”, ha affermato Kirchenbauer. “Le migliori prestazioni si ottengono probabilmente se l’adattamento MTP viene eseguito utilizzando le richieste del dominio di distribuzione.”

Al servizio della compatibilità e della strada da percorrere

Il gruppo di ricerca ha rilasciato il loro modelli addestrati su Hugging Face e presto verrà rilasciato il codice per il loro framework MTP. I crew dell’infrastruttura che integrano questi modelli in vLLM o SGLang dovranno tenere conto dei cambiamenti nel modo in cui vengono gestiti il batching e il caching KV, ma si tratta di un investimento tecnico una tantum, non di un onere continuo. Tuttavia, Kirchenbauer non vede “alcuni ostacoli evidenti all’integrazione” e ha confermato che il crew sta “lavorando con alcuni esperti di sistemi per identificare il percorso più breve verso l’integrazione”.

Il consiglio di Kirchenbauer per i crew che desiderano testare i modelli rilasciati: inizia con suggerimenti giocattolo come contare o ripetere una frase per vedere i vantaggi di ConfAdapt in azione, quindi adattare il modello utilizzando campioni dal tuo dominio di distribuzione specifico per ottenere i migliori risultati. “Nel complesso ci aspettiamo che un’implementazione pronta per la produzione del nostro approccio possa semplificare il ciclo di vita della costruzione e dell’implementazione di modelli agentici a bassa latenza”, ha concluso Kirchenbauer. “Mentre le tecniche di accelerazione esistenti per i modelli NTP si concentrano quasi esclusivamente sui cablaggi di inferenza e sulla logica, il nostro approccio inserisce solo parte della complessità nel modello stesso rendendolo ampiamente complementare al lavoro esistente.”