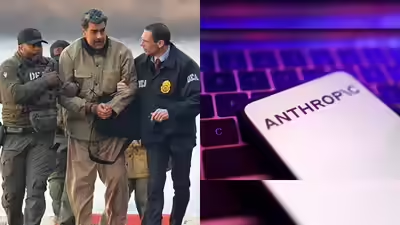

Il modello di intelligenza artificiale di Anthropic, Claude, è stato utilizzato nell’operazione militare statunitense che ha catturato l’ex presidente venezuelano Nicolas Maduro, ha riferito venerdì il Wall Road Journal, citando persone a conoscenza della questione.La missione per catturare Maduro e sua moglie prevedeva il bombardamento di diversi siti a Caracas il mese scorso. Gli Stati Uniti hanno arrestato Maduro in un raid di inizio gennaio e lo hanno trasportato a New York per affrontare le accuse di traffico di droga.Secondo il Wall Road Journal, l’implementazione di Claude è avvenuta attraverso la partnership di Anthropic con la società di analisi dei dati Palantir Applied sciences, le cui piattaforme sono ampiamente utilizzate dal Dipartimento della Difesa degli Stati Uniti e dalle forze dell’ordine federali.Reuters non ha potuto verificare in modo indipendente il rapporto. Il Dipartimento della Difesa americano e la Casa Bianca non hanno risposto immediatamente alle richieste di commento. Anche Palantir non ha risposto immediatamente.Anthropic ha affermato di non poter commentare i dettagli operativi.“Non possiamo commentare se Claude, o qualsiasi altro modello di intelligenza artificiale, sia stato utilizzato per operazioni specifiche, classificate o meno”, ha detto un portavoce di Anthropic. “Qualsiasi utilizzo di Claude, sia nel settore privato che in quello governativo, è tenuto a rispettare le nostre Politiche di utilizzo, che regolano le modalità di distribuzione di Claude. Lavoriamo a stretto contatto con i nostri associate per garantire la conformità.”Il Dipartimento della Difesa ha rifiutato di commentare, secondo il Wall Road Journal.Le politiche di utilizzo di Anthropic vietano che Claude venga utilizzato per facilitare la violenza, sviluppare armi o condurre attività di sorveglianza. L’uso segnalato del modello in un raid che prevedeva operazioni di bombardamento evidenzia crescenti domande su come gli strumenti di intelligenza artificiale vengono utilizzati in contesti militari.Il Wall Road Journal aveva precedentemente riferito che le preoccupazioni di Anthropic su come Claude potrebbe essere utilizzato dal Pentagono hanno portato i funzionari dell’amministrazione a considerare la cancellazione di un contratto del valore di fino a 200 milioni di dollari.Anthropic è stato il primo sviluppatore di modelli di intelligenza artificiale advert essere utilizzato in operazioni riservate dal Dipartimento della Difesa, secondo persone a conoscenza della questione citate dal Wall Road Journal. Non è chiaro se altri strumenti di intelligenza artificiale siano stati utilizzati nell’operazione in Venezuela per compiti non classificati.Il Pentagono ha spinto le principali società di intelligenza artificiale, tra cui OpenAI e Anthropic, a rendere i loro strumenti disponibili su reti riservate senza molte delle restrizioni customary applicate agli utenti commerciali, ha riferito in esclusiva Reuters all’inizio di questa settimana.Molte aziende di intelligenza artificiale stanno costruendo sistemi personalizzati per le forze armate statunitensi, sebbene la maggior parte operi solo su reti non classificate utilizzate per funzioni amministrative. Anthropic è attualmente l’unico grande sviluppatore di intelligenza artificiale il cui sistema è accessibile in ambienti classificati tramite terze parti, sebbene gli utenti governativi rimangano vincolati dalle sue politiche di utilizzo.Anthropic, che ha recentemente raccolto 30 miliardi di dollari in un spherical di finanziamento per un valore di 380 miliardi di dollari, si è posizionata come una società di intelligenza artificiale focalizzata sulla sicurezza. L’amministratore delegato Dario Amodei ha pubblicamente chiesto una regolamentazione più forte e misure di protezione per mitigare i rischi derivanti dai sistemi avanzati di intelligenza artificiale.In un evento di gennaio in cui si annunciava la collaborazione del Pentagono con xAI, il segretario alla Difesa Pete Hegseth ha affermato che l’agenzia non “impiegherà modelli di intelligenza artificiale che non consentiranno di combattere guerre”, riferendosi alle discussioni che i funzionari dell’amministrazione hanno avuto con Anthropic, ha riferito il Wall Road Journal.La relazione in evoluzione tra gli sviluppatori di intelligenza artificiale e il Pentagono riflette un cambiamento più ampio nella strategia di difesa, poiché gli strumenti di intelligenza artificiale sono sempre più utilizzati per compiti che vanno dall’analisi dei documenti e dal riepilogo dell’intelligence al supporto di sistemi autonomi.L’uso segnalato di Claude nel raid di Maduro sottolinea il ruolo crescente dei modelli commerciali di intelligenza artificiale nelle operazioni militari statunitensi, anche se continuano i dibattiti sui limiti etici, sulle politiche di utilizzo e sulla supervisione normativa.

Cos’è Claude di Anthropic?

Claude di Anthropic è un chatbot avanzato di intelligenza artificiale e un modello linguistico di grandi dimensioni progettato per la generazione di testo, il ragionamento, la codifica e l’analisi dei dati, sviluppato dalla società di intelligenza artificiale Anthropic con sede negli Stati Uniti.Claude fa parte di una famiglia di grandi modelli linguistici costruiti per competere con sistemi come ChatGPT di OpenAI e Gemini di Google. Può riassumere documenti, rispondere a domande complesse, generare report, assistere nelle attività di programmazione e analizzare grandi volumi di testo.Anthropic posiziona Claude come un sistema di intelligenza artificiale incentrato sulla sicurezza. L’azienda ha creato politiche di utilizzo che vietano che il modello venga utilizzato per sostenere la violenza, sviluppare armi o condurre attività di sorveglianza. Claude è disponibile per aziende e clienti governativi, anche su alcune reti riservate attraverso partnership approvate.Fondata nel 2021 da ex dirigenti di OpenAI, incluso il CEO Dario Amodei, Anthropic è emersa come una delle principali startup di intelligenza artificiale a livello globale, con il sostegno di importanti investitori tecnologici e una valutazione di centinaia di miliardi di dollari